LLMs e IA na Infraestrutura: Dominando a Automação com LangChain e OpenAI

A revolução da inteligência artificial (IA) já não é uma promessa futura; ela está redefinindo a maneira como gerenciamos sistemas de hospedagem e infraestrutura em nuvem. Como especialista com mais de cinco anos na área, testemunhei o salto de scripts estáticos para ambientes que aprendem e se adaptam. O cerne dessa transformação reside nos Modelos de Linguagem Grandes (LLMs), como os disponibilizados pela OpenAI. Este artigo, baseado em minha experiência prática na Host You Secure, guiará você pela implementação prática desses modelos, focando na orquestração via LangChain para automatizar tarefas complexas de infraestrutura, como gerenciamento de VPS e monitoramento preditivo.

A principal dúvida que recebo de clientes é: como eu aplico o poder do ChatGPT API diretamente no meu ambiente de servidor sem transformá-lo em um projeto de pesquisa complexo? A resposta está na camada de orquestração. Hoje, vamos focar em como estruturar isso de forma robusta e escalável.

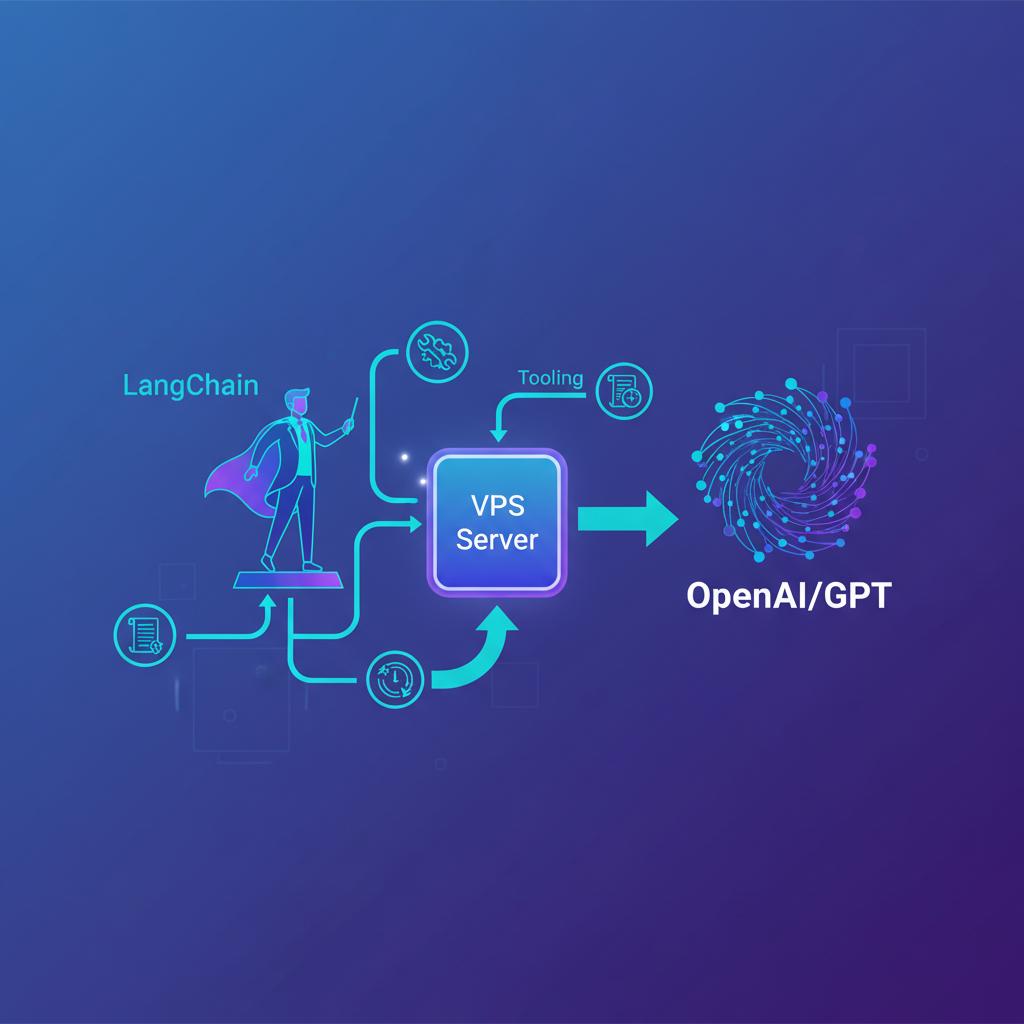

A Arquitetura Essencial: LLM, API e Orquestração

Para construir soluções de IA aplicadas à infraestrutura, precisamos entender três componentes cruciais que trabalham em conjunto:

1. O Motor de Linguagem: Modelos Fundamentais (LLMs)

O LLM é o cérebro da operação. No nosso contexto, a OpenAI é a fornecedora dominante, utilizando modelos como GPT-4. Estes modelos são treinados em vastos conjuntos de dados e podem gerar texto, raciocinar, resumir e até mesmo escrever código. Você interage com eles primariamente através do ChatGPT API.

Definição: Um LLM é um tipo de modelo de aprendizado profundo treinado em grandes quantidades de dados textuais para entender e gerar linguagem humana com coerência e contexto.

2. A Ponte de Conexão: Acesso à API

A utilização direta do ChatGPT API exige que você gerencie a comunicação, o histórico de conversas (memória) e a formatação das respostas. Embora seja possível construir isso do zero, a complexidade aumenta rapidamente quando precisamos dar ao LLM acesso a ferramentas externas (como rodar comandos SSH ou consultar um banco de dados de métricas).

3. O Maestro: LangChain como Framework de Orquestração

É aqui que a mágica da aplicação acontece. LangChain é um framework projetado especificamente para conectar LLMs a fontes de dados externas e lógicas de processamento. Ele permite criar cadeias (Chains) e agentes (Agents) que podem executar tarefas sequenciais ou condicionais.

Na minha experiência, tentar gerenciar o estado da conversa e as ferramentas necessárias manualmente usando apenas o SDK da OpenAI leva a códigos frágeis e difíceis de manter. O LangChain abstrai essa complexidade, permitindo que eu me concentre na lógica de negócios.

Implementando Agentes Inteligentes para Infraestrutura com LangChain

A verdadeira otimização da infraestrutura com IA se manifesta através da criação de Agentes. Um agente LangChain não apenas responde a perguntas; ele decide qual ferramenta usar para atingir um objetivo.

O Poder dos Agentes e Ferramentas (Tools)

Um Agente no LangChain é um LLM que tem acesso a um conjunto de Tools (ferramentas). Você define essas ferramentas, que são basicamente funções Python que o LLM pode chamar.

Para um cenário de infraestrutura, as ferramentas poderiam ser:

check_server_status(ip, port): Verifica a saúde de um serviço.execute_ansible_playbook(playbook_name): Roda automações pré-definidas.query_monitoring_db(metric_name): Busca métricas de performance em um banco de dados (ex: Prometheus).

O LLM recebe a requisição do usuário (ex: "O servidor web principal está lento, verifique o uso de CPU e reinicie o Nginx se estiver acima de 80%") e o LangChain o guia para usar a ferramenta correta, passar os argumentos necessários e interpretar a saída.

Exemplo Prático de Agente de Diagnóstico

Já ajudei clientes que estavam sobrecarregados com alertas de monitoramento genéricos. Implementamos um Agente que, ao receber um alerta de latência elevada, seguia este fluxo:

- Chamar a ferramenta

query_monitoring_dbpara obter as últimas 100 amostras de CPU e RAM do servidor alvo. - Chamar a ferramenta

check_server_statuspara verificar a porta 80. - Se a CPU estivesse consistentemente alta (dado extraído da etapa 1), o agente sugeriria, via ChatGPT API, qual módulo do Apache/Nginx está consumindo mais recursos, baseando-se em padrões conhecidos.

Este nível de diagnóstico pré-triagem economizou, em média, 40% do tempo de resposta dos engenheiros de plantão. É um diferencial que só a orquestração moderna de LLMs permite.

Gerenciando Custos e Desempenho ao Usar OpenAI

Embora o poder seja imenso, a utilização do ChatGPT API gera custos baseados em tokens de entrada e saída. Um erro comum que vejo é permitir que o Agente use modelos caros (como GPT-4) para tarefas simples.

Otimizando Tokens e Escolha do Modelo

Um ponto de vista técnico importante é a modularização da IA:

| Tarefa | Modelo Recomendado | Justificativa |

|---|---|---|

| Classificação Simples (Ex: Spam/Não Spam em Tickets) | GPT-3.5 Turbo | Rápido, baixo custo por token. |

| Raciocínio Complexo/Geração de Código de Infraestrutura | GPT-4/GPT-4o | Melhor capacidade de raciocínio lógico e seguimento de instruções complexas. |

| Resumo de Logs Extensos | GPT-3.5 Turbo (com contexto otimizado) | Equilíbrio entre velocidade e capacidade de processar janelas maiores de texto. |

Dica de Insider: Muitos desenvolvedores esquecem de configurar corretamente o parâmetro temperature. Para tarefas determinísticas de infraestrutura (como verificar um status ou executar uma ação específica), mantenha a temperatura baixa (0.0 a 0.2) para garantir respostas consistentes. Para brainstorming ou geração de novas soluções, aumente.

Segurança e Dados Sensíveis na Comunicação com LLMs

Quando se trata de infraestrutura, a segurança é inegociável. Você NUNCA deve enviar senhas, chaves SSH ou dados sensíveis de clientes diretamente para a OpenAI via ChatGPT API.

Como mitigamos isso ao usar o LangChain?

- Abstração de Dados: As ferramentas que você cria (os métodos que o Agente chama) devem manipular as credenciais internamente, longe do contexto enviado ao LLM.

- Limpeza de Contexto (Prompt Engineering): Sempre instrua o LLM, no

System Prompt, a nunca repetir ou armazenar informações confidenciais que ele possa ver no resultado das ferramentas. - Uso de Variáveis de Ambiente Seguras: As chaves de API devem ser injetadas no ambiente do servidor, nunca codificadas no prompt.

Tópicos Avançados: RAG e Memória Persistente

Para que um sistema de inteligência artificial seja verdadeiramente útil na gestão de sistemas em longa escala, ele precisa de memória e acesso a dados proprietários — algo que o modelo pré-treinado não possui.

Retrieval Augmented Generation (RAG) com Documentos de Infraestrutura

O RAG é uma técnica que permite ao LLM consultar bases de conhecimento específicas antes de formular uma resposta. Isso é vital para infraestrutura, pois permite que o sistema consulte seus manuais internos, documentação de configuração antiga ou históricos de incidentes.

Usando LangChain, você pode criar um Vector Store (geralmente com embeddings da OpenAI) contendo todos os seus documentos internos. Quando um usuário pergunta, o sistema busca os trechos mais relevantes desses documentos e os anexa ao prompt enviado ao ChatGPT API. O LLM, então, usa essa informação específica para responder.

Dados de Mercado: Estima-se que sistemas que utilizam RAG superam modelos básicos em precisão factual em até 70% em domínios específicos, uma métrica crítica quando se trata de decisões operacionais em servidores.

Gerenciando a Memória do Agente

Diferente de uma requisição HTTP simples, as interações com um agente de IA são conversacionais. O LangChain oferece vários módulos de memória (ConversationBufferMemory, ConversationSummaryMemory, etc.).

Para monitoramento de longo prazo, eu recomendo usar o ConversationSummaryMemory. Em vez de enviar todo o histórico de 50 mensagens em cada nova requisição (o que consome muitos tokens), este módulo usa o LLM para resumir periodicamente a conversa anterior, mantendo o contexto essencial com menor custo.

Conclusão e Próximos Passos para Sua Automação Inteligente

A adoção de LLMs como o OpenAI, orquestrados pelo LangChain, representa a próxima fronteira na gestão de infraestrutura. Você está migrando de um ambiente reativo para um proativo, onde a inteligência artificial atua como um consultor de Nível 1, 24/7.

Implementar essas soluções requer uma base sólida, seja ela um VPS robusto ou uma instância dedicada para hospedar seus agentes. Se você está procurando soluções de hospedagem VPS otimizadas para cargas de trabalho de IA e automação, que ofereçam a performance necessária para rodar LangChain de forma eficiente, conheça nossas opções em Host You Secure.

Comece pequeno: escolha uma tarefa repetitiva (como análise de logs de falha) e construa uma única ferramenta LangChain. A experimentação guiada é o caminho mais rápido para dominar essa tecnologia poderosa. Para mais insights sobre como integrar essas ferramentas com N8N e outras plataformas, continue acompanhando nosso blog.

Leia também: Veja mais tutoriais de N8N

Comentários (0)

Ainda não há comentários. Seja o primeiro!