Dominando LLMs: Da Teoria à Automação Complexa com LangChain e Infraestrutura VPS

A ascensão dos Large Language Models (LLMs), popularizados por ferramentas como o ChatGPT API, marca um divisor de águas na inteligência artificial. No meu dia a dia na Host You Secure, vejo empresas lutando para ir além do uso básico de chatbots e integrar LLMs em fluxos de trabalho complexos. A chave para essa transição é entender não apenas o modelo em si, mas as ferramentas que permitem a orquestração. Este artigo técnico visa fornecer um guia prático sobre como utilizar LLMs de forma estratégica, focando na implementação com LangChain e a importância de uma infraestrutura confiável.

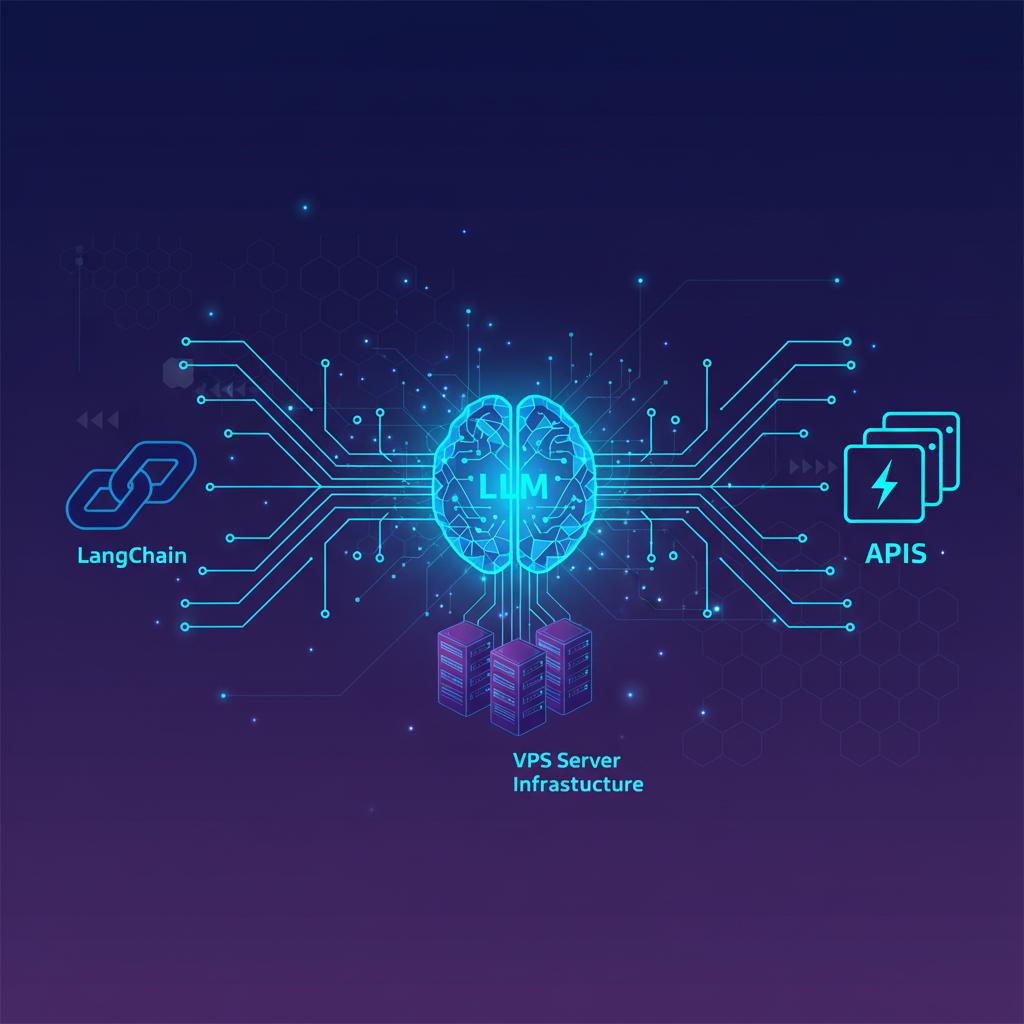

Para começar, a resposta direta é: dominar LLMs na prática requer a combinação de um modelo de base forte (como os da OpenAI) com um framework de orquestração como o LangChain. Este framework permite encadear chamadas, gerenciar contexto complexo e integrar o LLM com fontes de dados externas, o que é essencial para transformar a teoria da IA em soluções de negócios tangíveis, frequentemente implementadas em VPSs dedicadas.

O Ecossistema dos LLMs: Além do ChatGPT

Embora o ChatGPT seja o nome mais conhecido, o termo LLM abrange uma vasta família de modelos. Entender as opções e suas limitações é crucial para qualquer arquiteto de soluções.

1. Escolhendo o Modelo Certo: OpenAI e Alternativas

A OpenAI continua sendo o padrão ouro em muitos casos, especialmente com seus modelos GPT-4. Eles oferecem excelente capacidade de raciocínio e seguimento de instruções.

- GPT-3.5 Turbo: Excelente custo-benefício para tarefas de alta taxa de transferência (volume).

- GPT-4 / GPT-4o: Necessário para raciocínio complexo, análise de documentos longos e tarefas criativas de alta fidelidade.

Na minha experiência, muitos clientes subestimam o custo marginal de usar GPT-4 para tarefas simples. Já ajudei empresas a otimizar seus orçamentos de API em até 40% ao segmentar as requisições, usando modelos menores (ou até mesmo modelos open source hospedados localmente em nossa infraestrutura) para o trabalho repetitivo e reservando o GPT-4 para decisões críticas.

2. A Importância da Infraestrutura (VPS e Hospedagem)

A execução de código que interage com APIs de LLM requer estabilidade e baixa latência. Ao integrar o LLM em sistemas críticos, como sistemas de atendimento ao cliente ou processamento de dados internos, você não pode depender de infraestrutura incerta. Por isso, a escolha de um bom servidor VPS é fundamental. Um VPS bem configurado garante:

- Latência Consistente: Fundamental para manter a fluidez da interação do usuário com a aplicação que consome o LLM.

- Segurança de Dados: Para aplicações que envolvem dados sensíveis, hospedar a lógica de orquestração perto de seus outros serviços (em um VPS privado) é mais seguro do que depender apenas de soluções SaaS externas.

Se você está construindo uma aplicação de missão crítica baseada em IA, considere soluções dedicadas. Confira nossas ofertas de VPS otimizadas para desenvolvimento e automação.

LangChain: O Orquestrador de Inteligência Artificial

Um LLM sozinho é apenas um motor de texto; ele não sabe como acessar dados em tempo real, interagir com um banco de dados ou seguir um processo multi-etapas. É aí que entra o LangChain. O LangChain é um framework que facilita a criação de aplicações complexas baseadas em LLMs, permitindo a construção de 'chains' (cadeias) de operações.

1. Componentes Fundamentais do LangChain

Para entender o LangChain, você precisa conhecer seus pilares:

- Models (Modelos): A interface para interagir com os LLMs (como OpenAI, Hugging Face, etc.).

- Prompts: Templates para estruturar as entradas enviadas ao modelo, garantindo que a saída seja previsível.

- Chains (Cadeias): A sequência de chamadas, onde a saída de um componente se torna a entrada do próximo.

- Agents (Agentes): O nível mais avançado, onde o LLM decide qual 'ferramenta' (tool) usar para completar uma tarefa (ex: buscar na web, executar código Python).

2. Exemplo Prático: Recuperação Aumentada por Geração (RAG)

Um dos casos de uso mais comuns e poderosos que implementamos é o RAG. O RAG permite que o LLM responda a perguntas com base em seus próprios documentos, superando a limitação do conhecimento pré-treinado.

Dica de Insider: O erro mais comum ao implementar RAG é usar embeddings (vetores) de baixa qualidade ou um tamanho de chunk (pedaço de texto) inadequado. Se os chunks forem muito pequenos, perde-se o contexto; se forem muito grandes, o custo da consulta vetorial aumenta e a relevância pode cair.

O processo básico com LangChain envolve:

- Carregar documentos (PDFs, TXT, etc.).

- Dividir em pedaços (chunks) e criar vetores (embeddings).

- Armazenar no banco de dados vetorial (ex: ChromaDB, Pinecone).

- Quando o usuário pergunta, o LangChain consulta o vetor para encontrar os documentos mais relevantes.

- Ele injeta esses trechos relevantes no prompt do LLM (via ChatGPT API, por exemplo) para gerar a resposta final.

Para rodar sua própria orquestração, um ambiente Python estável em um VPS é ideal. Veja um exemplo simplificado de como inicializar um chain básico:

from langchain_openai import ChatOpenAI

from langchain.prompts import ChatPromptTemplate

from langchain.chains import LLMChain

# 1. Inicializar o modelo (usando variável de ambiente para a chave da OpenAI)

llm = ChatOpenAI(model="gpt-3.5-turbo", temperature=0.7)

# 2. Definir o prompt

prompt = ChatPromptTemplate.from_template(

"Você é um assistente técnico. Responda à seguinte pergunta: {pergunta}"

)

# 3. Criar a cadeia

chain = LLMChain(llm=llm, prompt=prompt)

# 4. Executar

resposta = chain.invoke({"pergunta": "Qual é a principal diferença entre LangChain e N8N?"})

print(resposta['text'])

Otimizando Performance e Custo com Integrações

Atingir escala com inteligência artificial traz desafios de custo e latência. A otimização deve ser contínua.

1. Estratégias de Caching e Memória

Chamadas de API para LLMs, especialmente os mais avançados como o GPT-4, custam dinheiro. Se um usuário faz a mesma pergunta várias vezes em uma sessão, você não deve gastar tokens toda vez.

- Caching: Implemente um sistema de cache simples (Redis ou até mesmo um dicionário Python se a aplicação for pequena) para armazenar respostas recentes.

- Memória em Agentes: Em aplicações de conversação (chatbots), é crucial usar os módulos de Memory do LangChain. Isso permite que o Agente se lembre de interações passadas, simulando uma conversa coerente sem precisar reenviar todo o histórico a cada turno.

2. Automação de Fluxos de Trabalho Complexos (N8N e LLMs)

Onde a verdadeira mágica da automação acontece é quando combinamos o poder de raciocínio do LLM com plataformas de automação como o N8N. O N8N, por exemplo, é excelente para orquestrar fluxos de trabalho que envolvem APIs externas, bancos de dados e serviços de terceiros.

Caso de Uso Real: Triagem Inteligente de Suporte

Já desenvolvi um fluxo onde um ticket de suporte entrante (via Zendesk ou e-mail) era primeiramente enviado para um LLM orquestrado via LangChain. O LLM classificava a urgência, extraía palavras-chave e identificava se a solução estava no nosso banco de conhecimento interno (RAG). O resultado era então passado para um nó específico no N8N, que decidia:

- Se a resposta era trivial, o N8N a enviava de volta ao cliente via API de resposta automática.

- Se a classificação indicava alta complexidade ou erro de sistema, o N8N criava uma tarefa de alta prioridade no Jira, anexando a análise prévia do LLM.

Isso reduziu o tempo de resposta inicial em 70%. Segundo dados recentes do setor, estima-se que 65% das interações de suporte ao cliente poderão ser automatizadas ou aprimoradas por IA generativa até 2026.

Desafios e Armadilhas Comuns na Implementação de LLMs

A adoção de LLMs não é isenta de riscos. Como especialista em infraestrutura e automação, meu papel é mitigar esses riscos antes que se tornem problemas de produção.

1. Alucinações e Verificação de Fatos

O problema mais persistente da inteligência artificial generativa é a tendência de 'alucinar' – gerar informações factualmente incorretas com grande confiança.

Como Evitar: Nunca confie cegamente na saída de um LLM para dados críticos. Sempre implemente uma camada de verificação. Se o LLM estiver acessando dados externos (via Agentes ou RAG), valide se a resposta gerada pode ser rastreada até a fonte de dados fornecida. Se estiver usando o LLM para gerar código ou cálculos financeiros, use ferramentas de execução segura (sandboxed execution) em seu VPS para validar o resultado antes de apresentá-lo.

2. Segurança e Vazamento de Dados (Prompt Injection)

Ataques de Prompt Injection são uma ameaça séria. Um usuário malicioso pode tentar enganar o LLM para que ele ignore suas instruções de sistema e execute ações indesejadas (como revelar informações de contexto ou chaves de API que você injetou no prompt do sistema).

Medida de Mitigação: Segmente as permissões. Nunca injete chaves de API sensíveis diretamente no contexto de um modelo que aceita entrada de usuários não confiáveis. Utilize o LangChain para separar prompts de sistema (as regras do seu agente) dos prompts de usuário (a entrada da requisição).

Conclusão: Integrando o Poder da IA em Sua Stack

Dominar os LLMs não é apenas sobre entender o que a OpenAI está lançando; é sobre construir sistemas robustos e orquestrados. O LangChain fornece a estrutura necessária para transformar modelos poderosos em aplicações úteis, capazes de automatizar processos complexos que antes exigiam intervenção humana constante. Lembre-se que a base de tudo isso, seja para hospedar seu código de automação ou para servir modelos menores, deve ser uma infraestrutura VPS confiável e de baixa latência.

Se você busca levar sua automação baseada em IA para o próximo nível, garantindo segurança e desempenho para suas integrações com ChatGPT API e outras tecnologias, a Host You Secure está pronta para fornecer a fundação necessária. Continue explorando nossos artigos técnicos para aprofundar seus conhecimentos em automação e infraestrutura cloud.

Leia também: Veja mais tutoriais de N8N

Comentários (0)

Ainda não há comentários. Seja o primeiro!