Dominando LLMs: Da OpenAI ao LangChain na Prática com Arquitetura Cloud

A ascensão dos LLMs (Large Language Models), popularizada pelo ChatGPT API da OpenAI, não é apenas uma tendência, mas uma mudança fundamental na forma como interagimos com a tecnologia. Como especialista em infraestrutura cloud e automação com a Host You Secure, vejo diariamente a necessidade de migrar da teoria para a implementação prática. Se você está buscando construir aplicações inteligentes, entender a arquitetura por trás desses modelos é crucial. Este artigo detalha como integrar e orquestrar LLMs de forma eficiente, usando minha experiência real no campo.

1. Fundamentos Essenciais: Entendendo os LLMs

Um LLM é um tipo de inteligência artificial treinado em vastas quantidades de texto, capaz de gerar texto coerente, traduzir idiomas, responder a perguntas e até mesmo escrever código. O sucesso inicial da OpenAI com o GPT demonstrou o potencial comercial e prático desses modelos.

1.1 O Papel da OpenAI e o Acesso via API

A OpenAI estabeleceu o padrão da indústria, fornecendo acesso aos seus modelos (como GPT-4 e GPT-3.5 Turbo) através de uma API. Esta é a porta de entrada mais comum para desenvolvedores. Em vez de treinar um modelo do zero (o que requer recursos astronômicos), utilizamos o poder computacional deles, pagando por token de entrada e saída.

Para começar, você precisa de uma chave de API. É vital tratar essa chave com o mesmo rigor de uma senha mestra, garantindo que ela nunca seja exposta no código cliente (front-end) ou em repositórios públicos. Na minha experiência ajudando clientes a configurar ambientes seguros, sempre recomendamos o uso de variáveis de ambiente no servidor de hospedagem (VPS) para armazenar credenciais.

1.2 Tokens, Context Window e Custos

Um conceito chave é o token. Tokens são pedaços de palavras que o modelo processa. A performance e o custo do seu LLM dependem diretamente da quantidade de tokens enviados (prompt) e recebidos (resposta). Além disso, o context window (janela de contexto) define quantos tokens o modelo pode lembrar em uma única conversa. Se o histórico for muito longo, ele será truncado, levando à perda de memória.

Dica de Insider: Muitos desenvolvedores iniciantes desperdiçam tokens enviando o histórico completo da conversa a cada requisição. Implementar uma estratégia de sumarização ou um buffer de memória fixo é crucial para manter a performance e controlar os custos, especialmente ao usar o ChatGPT API em aplicações de alto volume.

2. Orquestração é a Chave: Introduzindo o LangChain

Usar um LLM diretamente é como usar um motor potente sem um chassi: funcional, mas limitado. Para criar aplicações complexas — como agentes autônomos, chatbots com memória persistente ou sistemas de recuperação de informação — precisamos de orquestração. É aqui que o LangChain brilha.

O LangChain é um framework poderoso, escrito principalmente em Python e JavaScript, projetado para simplificar o desenvolvimento de aplicações baseadas em LLMs. Ele permite encadear componentes de forma modular: modelos, prompts, memória, e ferramentas externas.

2.1 Componentes Fundamentais do LangChain

O poder do LangChain reside na sua modularidade. Os principais blocos de construção incluem:

- Models: Interfaces para interagir com diferentes provedores (OpenAI, Hugging Face, etc.).

- Prompts: Estruturas dinâmicas para criar instruções otimizadas para o LLM.

- Chains: Sequências pré-definidas de chamadas (ex: resumir um texto e depois traduzir o resumo).

- Agents: O nível mais avançado; permite que o LLM decida qual ferramenta (como uma busca na web ou execução de código) usar para responder a uma solicitação.

2.2 Estruturando sua Primeira Cadeia (Chain)

Na minha experiência, a melhor forma de entender o LangChain é construir algo tangível. Vamos considerar um cenário comum: um sistema de FAQ automatizado que precisa consultar uma base de conhecimento específica, algo que o LLM genérico não sabe.

Aqui, implementamos o padrão RAG (Retrieval-Augmented Generation). Isso envolve:

- Carregar documentos (seus PDFs, bases de dados).

- Dividi-los em pedaços (chunks).

- Converter esses pedaços em vetores numéricos usando um modelo de embedding.

- Armazenar em um Vector Store (ex: ChromaDB ou Pinecone).

- Quando o usuário pergunta, vetorizar a pergunta, buscar os chunks relevantes na base e injetá-los no prompt enviado ao ChatGPT API.

Para hospedar o backend dessa aplicação complexa, especialmente se ela envolver busca vetorial e múltiplas requisições assíncronas, um bom servidor VPS Linux otimizado é essencial. Recomendo sempre a arquitetura que nos permite escalar os recursos de CPU/RAM conforme a demanda do processamento da inteligência artificial.

3. Desafios de Infraestrutura e Escalabilidade

Implementar soluções baseadas em LLM não termina no código Python. A operação em produção exige considerações sérias de infraestrutura. Dados de mercado de 2023 mostram que a adoção empresarial de IA cresceu mais de 400% em um ano, o que pressiona a infraestrutura subjacente.

3.1 Gerenciamento de Sessão e Estado em Ambientes Cloud

Se você está construindo um chatbot conversacional usando LangChain, você precisa gerenciar o histórico da conversa (estado). Em um ambiente web típico, onde as requisições podem ser distribuídas por múltiplos servidores (load balancing), o estado da sessão não pode ficar apenas na memória de um único processo.

Exemplo Prático: Já ajudei clientes que tentavam armazenar o histórico de conversas do LangChain em variáveis locais do servidor. Quando o balanceador de carga roteava a segunda requisição para um servidor diferente, o LLM 'esquecia' o contexto anterior. A solução envolveu externalizar a memória usando bancos de dados como Redis ou PostgreSQL, acessíveis por todos os nós da sua aplicação em nuvem. Se você busca estabilidade e desempenho para sua aplicação de inteligência artificial, considere migrar para um VPS dedicado que ofereça controle total sobre essas configurações.

3.2 Latência e Otimização de Chamadas à API

A latência da resposta da OpenAI pode variar. Se sua aplicação é sensível ao tempo (ex: um chatbot de atendimento ao vivo), você precisa gerenciar as expectativas do usuário.

Tabela de Comparação de Latência (Estimativa Média):

| Modelo | Latência Típica (ms) | Custo/Token |

|---|---|---|

| GPT-3.5 Turbo | 400 - 1200ms | Baixo |

| GPT-4 Turbo | 800 - 2500ms | Alto |

Para mitigar a percepção de lentidão, sempre utilize streaming. O LangChain suporta nativamente o streaming, que exibe a resposta token por token, assim que ela chega da OpenAI, melhorando drasticamente a experiência do usuário. Garanta sua infraestrutura com a Host You Secure para rodar o código de orquestração com a menor latência possível.

4. Integrando Automação com LLMs (N8N e Outras Ferramentas)

A verdadeira automação surge quando conectamos a inteligência do LLM com fluxos de trabalho externos. Minha especialidade em N8N entra aqui. Enquanto o LangChain orquestra o modelo, ferramentas de automação sem código/low-code conectam isso ao mundo real (e-mail, CRM, planilhas).

4.1 LLMs como Agentes de Decisão no Fluxo de Trabalho

Imagine um cenário de triagem de tickets de suporte. Tradicionalmente, você usaria regras estáticas (If/Then). Com um LLM, você pode ter uma camada de inteligência artificial que interpreta a nuance da solicitação.

Usando o LangChain Agents, podemos fornecer ao modelo acesso a ferramentas como uma função para 'Categorizar Ticket' (que pode ser um webhook no N8N). O agente decide: se o ticket for sobre 'Faturamento', ele chama a ferramenta de faturamento; se for 'Técnico', ele chama a ferramenta de criação de Jira. Isso exige que o ambiente de execução do seu código (seja um container Docker rodando no VPS ou uma função serverless) consiga fazer chamadas HTTP seguras para os serviços externos.

4.2 O Erro Comum na Integração de Ferramentas

Um erro que vejo frequentemente é a dificuldade em definir as ferramentas para o Agente de forma clara. O Agente precisa de descrições muito precisas das ferramentas. Se a descrição for vaga, o LLM, mesmo sendo inteligente, não conseguirá escolher a ferramenta correta.

Exemplo de Prompt de Ferramenta Ruim: "Função para checar estoque."

Exemplo de Prompt de Ferramenta Otimizado (para LangChain): "

lookup_inventory(product_id: str) -> dict: Busca o estoque atualizado de um produto pelo seu ID único. Retorna um dicionário com a quantidade disponível.A clareza na definição das ferramentas é o que transforma um experimento divertido em uma automação confiável. Para mais dicas sobre como otimizar fluxos de trabalho complexos, visite nosso blog da Host You Secure.

Conclusão: O Futuro da Aplicação Inteligente

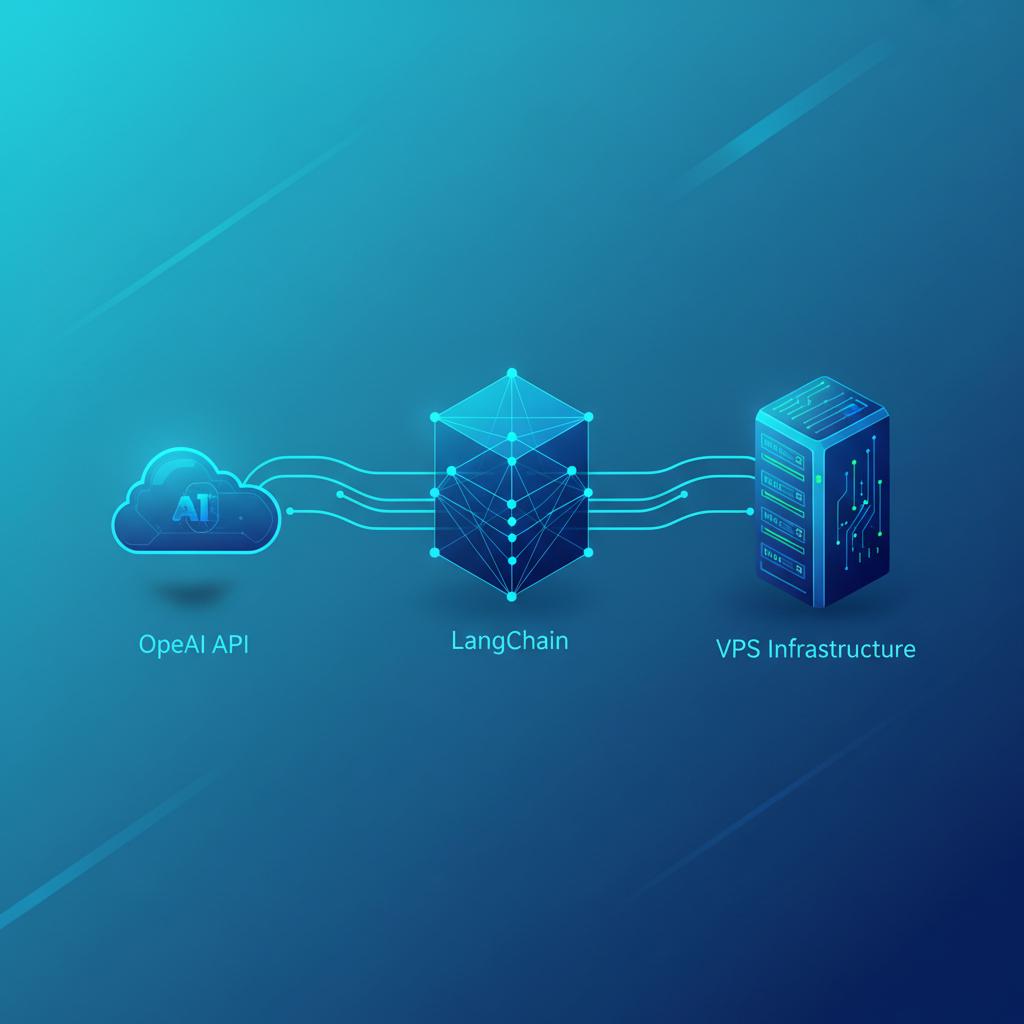

A capacidade de integrar LLMs como o ChatGPT API através de frameworks como LangChain abre um leque de possibilidades para automação e criação de produtos digitais. Dominar essa stack significa entender tanto a camada de modelo (via API da OpenAI) quanto a camada de orquestração (LangChain) e, crucialmente, a camada de infraestrutura (seu VPS ou cloud) que suporta a operação 24/7.

Comece pequeno, focando na segurança das suas chaves de API e na otimização dos seus prompts. À medida que sua aplicação cresce, não subestime a importância de uma infraestrutura dedicada para garantir baixa latência e alta disponibilidade. Se você está pronto para tirar seus projetos de inteligência artificial do papel com segurança e performance, explore nossas soluções de hospedagem otimizadas para aplicações de IA.

Leia também: Veja mais tutoriais de N8N

Comentários (0)

Ainda não há comentários. Seja o primeiro!