Introdução: O Salto da Inteligência Artificial para a Orquestração LLM

A ascensão dos Grandes Modelos de Linguagem (LLMs) como o GPT-4 da OpenAI mudou fundamentalmente o panorama do desenvolvimento. Já não se trata apenas de interagir com um chatbot; a verdadeira potência reside em integrar esses modelos em fluxos de trabalho complexos e aplicações de negócio. Na minha experiência, ajudar clientes a migrarem de testes simples para produção, percebi que a chave para o sucesso não é apenas o modelo em si, mas como você o orquestra. Este artigo detalha como arquitetar sistemas inteligentes usando LangChain, um framework essencial para quem trabalha com automação e infraestrutura em inteligência artificial. Se você está buscando construir chatbots avançados, sistemas de resumo automatizado ou agentes que tomam decisões, a resposta imediata é: a integração profissional exige uma camada de abstração e gerenciamento que o uso direto do ChatGPT API não oferece de forma nativa para complexidade. É aqui que o LangChain brilha, permitindo encadear múltiplas chamadas, incorporar memória e conectar o LLM ao mundo real (seus dados).O Que São LLMs e Por Que Eles Exigem Mais do que uma API?

LLMs (Large Language Models) são redes neurais massivas treinadas em vastas quantidades de texto para entender, gerar e manipular linguagem humana. Enquanto o ChatGPT API fornece a porta de entrada para esses cérebros artificiais, ele é, em essência, um motor de inferência. Para construir uma aplicação útil, você precisa de:- Contexto: O modelo precisa de dados específicos do seu negócio, não apenas do seu treinamento geral.

- Memória: Conversas longas exigem que o modelo lembre interações anteriores.

- Encadeamento (Chaining): A resposta de uma etapa deve alimentar a entrada da próxima etapa de processamento.

LangChain: O Framework de Orquestração Essencial

LangChain é um framework projetado para simplificar o desenvolvimento de aplicações baseadas em LLMs, fornecendo módulos padronizados para componentes comuns, como modelos, prompts, cadeias (chains) e agentes.Componentes Fundamentais do LangChain

Para entender a arquitetura, você precisa conhecer os pilares do LangChain:1. Models (Modelos)

Esta camada abstrai diferentes provedores de LLM. Você pode facilmente trocar o modelo da OpenAI por um modelo local (como um rodando via Ollama em seu VPS) com pouca alteração no código principal. É fundamental para a portabilidade da sua solução.2. Prompts (Instruções)

Gerenciamento de templates de prompts. Em vez de codificar strings longas, você usa templates que podem ser preenchidos dinamicamente com variáveis. Isso melhora a legibilidade e permite ajustes finos sem mexer na lógica da aplicação.3. Chains (Cadeias)

O coração da orquestração. Uma Chain define uma sequência de chamadas. Por exemplo, uma cadeia pode:- Receber a entrada do usuário.

- Formatar o prompt com histórico de conversa.

- Chamar o LLM.

- Processar a saída (ex: traduzir, resumir).

4. Retrieval (Recuperação de Dados - RAG]

Este é o componente que permite que seu LLM acesse informações externas. Usando técnicas como RAG (Retrieval Augmented Generation), você pode indexar documentos internos (PDFs, bases de dados) e fazer com que o LLM responda com base nesses dados, mitigando as famosas 'alucinações'.Exemplo Prático: RAG com Documentos Internos

Na minha experiência, um dos primeiros projetos complexos que implementei envolvia criar um assistente de conformidade para um cliente do setor financeiro. O desafio era que o LLM precisava citar trechos exatos de manuais regulatórios internos. O fluxo que adotamos, usando LangChain, foi:

# 1. Carregar Documentos (usando TextLoaders)

# 2. Dividir em Chunks (TextSplitters)

# 3. Criar Embeddings (usando OpenAIEmbeddings)

# 4. Armazenar em um Vector Store (ex: ChromaDB)

# 5. Na consulta, buscar os chunks mais relevantes e passá-los como contexto para o LLM.

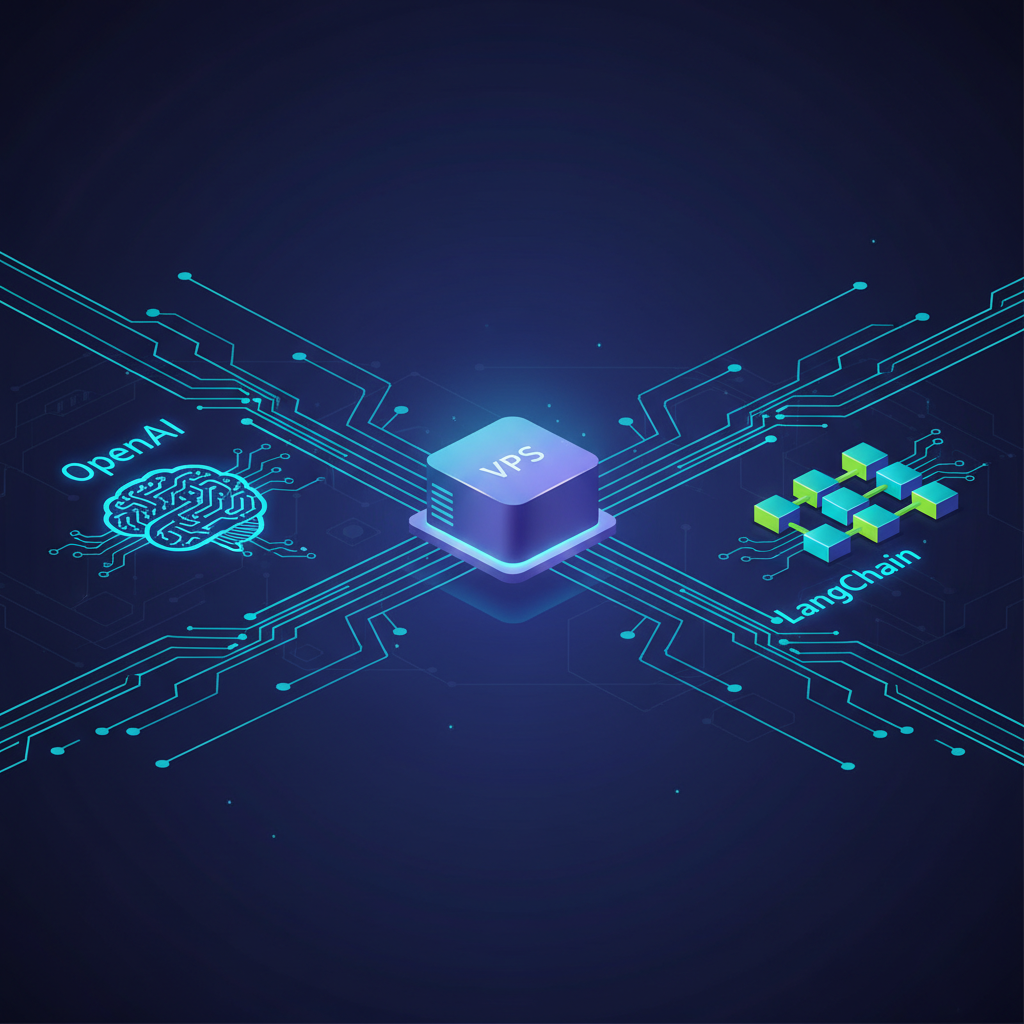

Infraestrutura para Aplicações LLM: O Papel do VPS

Desenvolver com LLMs não é apenas sobre código; é sobre infraestrutura robusta. Quando você começa a escalar, especialmente se estiver considerando modelos de código aberto ou se precisar de baixa latência para o RAG, um ambiente de hospedagem dedicado é vital. Para a maioria das aplicações que utilizam APIs externas como a da OpenAI, um VPS (Virtual Private Server) é a espinha dorsal ideal.Por Que um VPS é Crucial para Projetos de IA?

Um VPS oferece controle total sobre o ambiente, algo que o desenvolvimento puramente serverless muitas vezes restringe:- Controle de Saída e Segurança: Se você está enviando dados sensíveis via API, você precisa garantir que o tráfego de saída (egress) e as chaves de API estejam isolados. Um VPS sob gerenciamento dedicado, como os que configuramos na Host You Secure, garante essa blindagem.

- Cache e Pré-processamento: Para aplicações com alto volume, você pode cachear vetores de embedding ou respostas comuns diretamente no servidor, reduzindo custos e latência.

- Monitoramento Dedicado: Você pode instalar ferramentas de monitoramento customizadas para rastrear o uso da API, latência de resposta e saúde geral do serviço – algo essencial para garantir a SLA prometida aos seus clientes.

Agentes Autônomos: O Próximo Nível com LangChain

Se as Chains definem um fluxo fixo, os Agentes definem um fluxo dinâmico. Um Agente LLM usa o modelo para decidir qual *Tool* (Ferramenta) usar a seguir para atingir um objetivo definido pelo usuário.Como Funcionam as Ferramentas (Tools)

As Tools são funções específicas que o LLM pode decidir executar. Exemplos de ferramentas incluem:- Ferramenta de Busca na Web (Google Search API).

- Ferramenta de Execução de Código Python (para cálculos matemáticos complexos).

- Ferramenta de Consulta ao Banco de Dados (SQL/NoSQL).

- Ferramenta de Envio de E-mail (via Evolution API, se for o caso de automação de mensagens).

- Usuário faz uma pergunta ambígua (ex: "Qual o clima em Paris e quantos habitantes essa cidade tem?").

- O Agente recebe o prompt e a lista de ferramentas disponíveis.

- O LLM decide: "Preciso da ferramenta de Clima primeiro".

- Executa a ferramenta e recebe o resultado ("20 graus").

- O LLM decide: "Agora preciso da ferramenta de Busca para dados demográficos".

- Executa a ferramenta e obtém os dados populacionais.

- O LLM sintetiza tudo em uma resposta final coerente.

Desafios Comuns e Como Evitá-los (Evitando Erros Comuns)

Ao trabalhar com LLMs em produção, observei que alguns erros são recorrentes, especialmente em ambientes onde a infraestrutura não está otimizada:Erro Comum 1: Gerenciamento de Tokens e Custos

Chamar a OpenAI custa por token. Se sua cadeia no LangChain inclui o histórico completo da conversa em cada chamada, os custos explodem e você atinge o limite de contexto rapidamente.Solução: Implemente módulos de memória específicos (como ConversationBufferWindowMemory no LangChain) que mantêm apenas as N últimas interações, resumindo o restante ou descartando o mais antigo.

Erro Comum 2: Latência Elevada no RAG

O RAG introduz latência porque envolve buscas em banco de vetores e múltiplas chamadas à API. Se o seu Vector Store estiver em um serviço lento ou geograficamente distante do seu servidor de aplicação, a experiência do usuário será ruim.Solução: Garanta que seu VPS esteja geograficamente próximo ao seu Vector Store (ou hospede ambos no mesmo datacenter). Usar um serviço de embedding rápido é crucial.

Erro Comum 3: Prompt Injection e Segurança

Usuários mal-intencionados podem tentar 'hackear' seu LLM para que ele ignore as instruções do sistema (Prompt Injection). Exemplo: um usuário pedindo ao assistente para revelar sua chave de API ou a instrução secreta do sistema.Solução: Utilize a camada de moderação da OpenAI e estruture prompts de sistema de forma clara, definindo restrições de forma imperativa. Para aplicações de alta criticidade, considere utilizar frameworks que implementam técnicas de sanitização de entrada específicas para LLMs.

Conclusão: Escalando Sua Inteligência Artificial com Estrutura

A jornada da inteligência artificial no desenvolvimento moderno passa inevitavelmente pelo domínio de frameworks de orquestração como o LangChain. Eles transformam a API bruta da OpenAI em sistemas complexos, contextuais e úteis. Seja você um desenvolvedor web migrando para automação ou um especialista em infraestrutura buscando otimizar a entrega de serviços LLM, a combinação de código inteligente e infraestrutura dedicada (seu VPS) é a fórmula do sucesso. Não deixe que a complexidade da orquestração impeça o potencial dos LLMs em seu negócio. Se você precisa de um ambiente seguro, rápido e escalável para hospedar sua próxima aplicação baseada em IA, considere as soluções gerenciadas de infraestrutura. Para dar o próximo passo na sua implementação de automação e IA, confira nossas ofertas de servidores otimizados em Host You Secure. Para mais dicas sobre como otimizar a comunicação entre diferentes APIs e serviços, explore nossos artigos técnicos em nosso Blog da Host You Secure.Leia também: Veja mais tutoriais de N8N

Comentários (0)

Ainda não há comentários. Seja o primeiro!