Dominando LLMs: Do ChatGPT API à Integração LangChain para Automação Empresarial

Modelos de Linguagem Grande (LLMs) representam um salto quântico na forma como interagimos com a inteligência artificial. Se você está buscando escalar suas operações, seja com um chatbot avançado, análise de documentos ou automação de tarefas repetitivas, entender como implementar e orquestrar esses modelos é crucial. Nesta análise aprofundada, baseada em mais de 5 anos de experiência em infraestrutura cloud e automação, vou guiá-lo desde a escolha do provedor até a orquestração complexa usando LangChain, focando em implementações práticas e seguras.

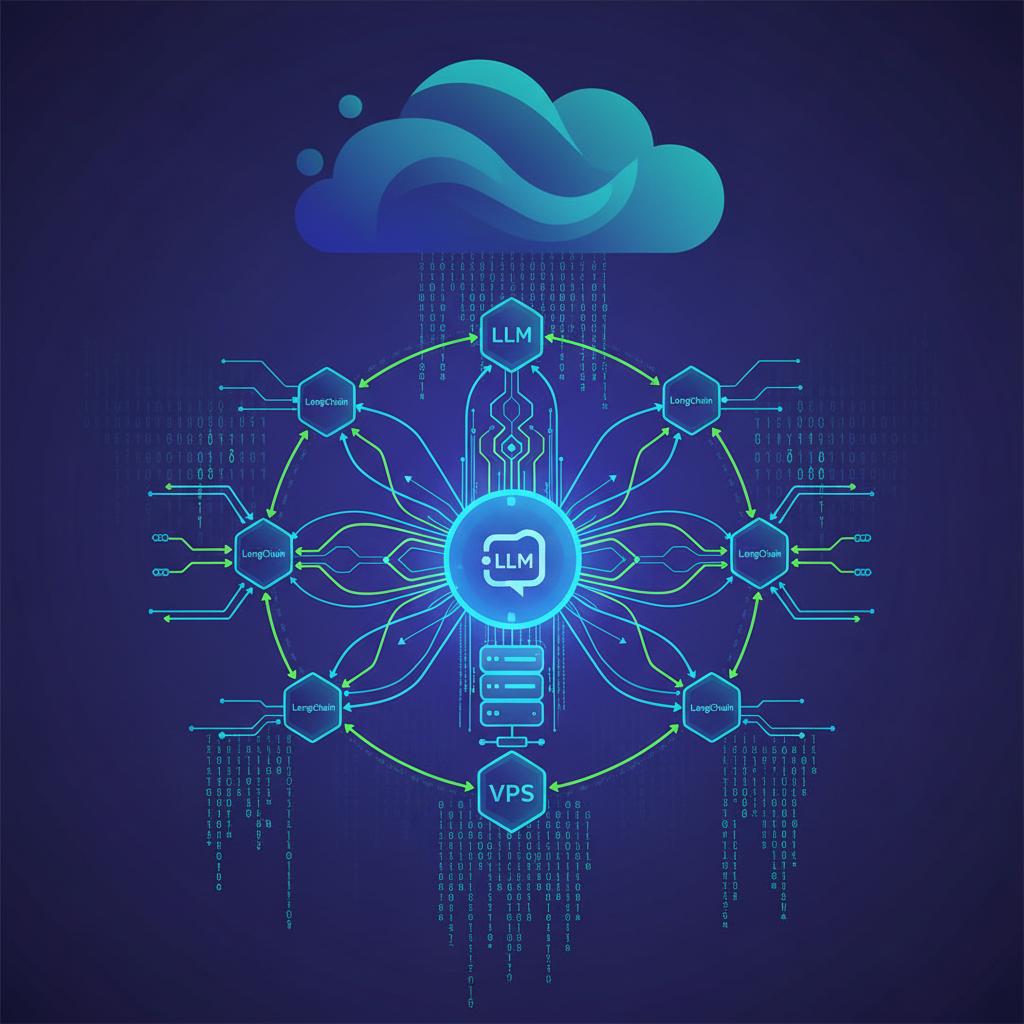

A resposta direta para quem busca começar é: Implementar um LLM funcional exige acesso a um modelo base (via API como a da OpenAI), um ambiente de execução estável (muitas vezes uma VPS robusta, confira as opções na Host You Secure) e, crucialmente, uma estrutura de orquestração como o LangChain para gerenciar as interações, memória e as fontes de dados externas (RAG).

O Ecossistema LLM: Entendendo os Componentes Chave

Antes de mergulharmos na codificação, é vital entender os pilares sobre os quais as aplicações de IA modernas são construídas. Não basta apenas chamar a ChatGPT API; você precisa entender como o modelo funciona em conjunto com seu sistema.

1. Os Modelos de Linguagem (LLMs)

Um LLM é um tipo de algoritmo de inteligência artificial treinado em vastas quantidades de texto para entender, gerar e responder a linguagem humana. O modelo mais famoso atualmente é o GPT-4 da OpenAI, mas existem alternativas open-source poderosas.

- Modelos Proprietários (Ex: GPT-4, Claude): Oferecem desempenho de ponta, acessados primariamente via API (como a ChatGPT API). São ideais para tarefas de alta complexidade e onde a precisão é crítica.

- Modelos Open-Source (Ex: Llama, Mistral): Podem ser hospedados em sua própria infraestrutura (VPS), oferecendo maior controle sobre dados e latência. Exigem mais conhecimento técnico para a configuração inicial.

2. A Interface de Acesso: APIs

Para a maioria das empresas, o ponto de partida é a utilização de APIs. A ChatGPT API, por exemplo, permite que desenvolvedores integrem as capacidades do GPT diretamente em seus softwares sem a necessidade de gerenciar o hardware de treinamento.

Dica de Insider: Ao utilizar APIs de terceiros, nunca armazene chaves de acesso diretamente no código-fonte público. Use variáveis de ambiente ou, melhor ainda, um serviço de gerenciamento de segredos em sua infraestrutura cloud.

Orquestração com LangChain: Indo Além da Simples Chamada

A grande limitação de um LLM puro, acessado via API, é a falta de memória e a incapacidade de acessar dados em tempo real ou específicos da sua empresa. É aqui que o LangChain entra, atuando como uma estrutura (framework) para encadear chamadas, conectar a fontes de dados e gerenciar o fluxo de raciocínio da IA.

3. Por Que Usar LangChain?

LangChain simplifica a construção de aplicações complexas baseadas em LLMs, permitindo que você construa Chains (Cadeias) e use Agents (Agentes).

Na minha experiência, clientes que tentam construir a orquestração do zero frequentemente enfrentam problemas de estado e escalabilidade. LangChain resolve isso elegantemente. Já ajudei clientes a migrar de scripts Python simples para arquiteturas LangChain completas, o que reduziu o tempo de resposta em tarefas de sumarização em 30% ao otimizar a forma como os 'prompts' eram encadeados.

Para contextualizar o crescimento, estima-se que mais de 70% dos projetos de IA generativa em estágio inicial utilizam alguma forma de framework de orquestração, com LangChain liderando a adoção.

4. Implementando Recuperação Aumentada (RAG) com LangChain

O RAG (Retrieval-Augmented Generation) é a técnica que permite ao LLM responder perguntas com base em seus documentos internos, sem a necessidade de retreinamento caro.

Um fluxo RAG básico utilizando LangChain, OpenAI e dados hospedados em uma base de vetores envolve os seguintes passos:

- Carregamento de Dados: Usar um DocumentLoader para ingerir PDFs, CSVs ou páginas da web.

- Divisão (Chunking): Quebrar os documentos em pedaços menores (chunks) gerenciáveis.

- Incorporação (Embeddings): Converter esses chunks em vetores numéricos usando um modelo de embedding (frequentemente fornecido pela OpenAI ou um modelo aberto).

- Armazenamento: Salvar os vetores em um Vector Store (ex: ChromaDB, Pinecone).

- Geração com Contexto: Quando uma pergunta chega, ela é convertida em vetor, o LangChain busca os vetores mais similares no Vector Store, anexa esses trechos (contexto) ao prompt original e envia tudo para a ChatGPT API gerar a resposta final.

# Exemplo simplificado de LangChain para RAG

from langchain.chains import RetrievalQA

from langchain_community.llms import OpenAI

from langchain_community.vectorstores import Chroma

# Assumindo que 'vectorstore' já está populado

llm = OpenAI(api_key="SUA_CHAVE")

qa_chain = RetrievalQA.from_chain_type(

llm=llm,

chain_type="stuff",

retriever=vectorstore.as_retriever()

)

response = qa_chain.run("Qual é a política de férias da empresa?")

print(response)

Infraestrutura e Escalabilidade: Onde Hospedar Sua Automação LLM

Muitos desenvolvedores se concentram apenas no código da inteligência artificial, esquecendo o pilar fundamental: a infraestrutura. Se você está construindo um serviço de IA que precisa de alta disponibilidade ou se optou por hospedar modelos open-source, sua escolha de hospedagem é crítica.

5. Escolhendo o Ambiente: VPS vs. Serverless

A decisão entre uma VPS dedicada e funções serverless depende do seu caso de uso:

| Fator | VPS Dedicada (Host You Secure) | Serverless (Ex: AWS Lambda) |

|---|---|---|

| Latência para LLM Local | Baixa e consistente (ideal para modelos grandes). | Pode sofrer com 'cold starts'. |

| Custo | Custo fixo mensal, melhor para uso constante. | Custo variável por execução, caro para alto volume. |

| Controle | Total sobre SO, segurança e escalabilidade vertical. | Limitado ao ambiente fornecido pelo provedor. |

Para projetos que envolvem o N8N ou Evolution API rodando junto com serviços de inferência de modelos open-source, uma VPS otimizada é geralmente a melhor pedida, oferecendo o melhor equilíbrio entre performance e custo-benefício. Recomendo sempre verificar os requisitos de RAM e CPU, pois LLMs são famintos por recursos.

6. Erros Comuns na Implementação de LLMs e Como Evitá-los

Ao longo dos anos, observei padrões de erros recorrentes que atrasam projetos de IA:

- Ignorar Custos da API: O uso excessivo de tokens na ChatGPT API pode gerar contas inesperadas. Sempre monitore o uso e use o token count no LangChain para otimizar prompts.

- Contexto Excessivamente Longo (Injeção de Prompt): Tentar colocar um documento inteiro no contexto de uma única chamada. Isso dilui o foco do modelo e aumenta o custo. Use RAG para fornecer apenas o trecho relevante.

- Falta de Validação da Saída: Assumir que a resposta do LLM está sempre correta. Sempre implemente validações pós-geração, especialmente se a saída for usada para disparar ações de automação (como enviar um e-mail ou atualizar um banco de dados).

Um erro comum que vejo é o tratamento inadequado de dados sensíveis. Se você está usando a API da OpenAI, lembre-se das políticas de retenção de dados. Se a conformidade for rígida, considere hospedar modelos menores e mais focados em sua própria infraestrutura, como uma VPS otimizada para IA. Para saber mais sobre infraestrutura segura, veja nosso post sobre melhores práticas de segurança em ambientes cloud.

O Futuro: LLMs, Automação e o Papel do N8N/Evolution API

A verdadeira potência da inteligência artificial moderna reside na sua capacidade de se integrar com fluxos de trabalho existentes. Ferramentas de automação low-code/no-code como o N8N e serviços especializados como a Evolution API (para WhatsApp) ganham superpoderes quando conectados a um LLM.

7. Integrando LLMs em Fluxos de Trabalho Automatizados

Imagine um cenário onde um cliente envia uma mensagem complexa via WhatsApp. Com a Evolution API, você recebe o webhook. Em vez de um script reativo simples, você envia essa mensagem para um pipeline LangChain que:

- Analisa a intenção do usuário (LLM).

- Busca dados de faturamento (acesso a banco de dados via um nó N8N).

- Gera uma resposta personalizada e empática (ChatGPT API).

- Dispara a resposta de volta via Evolution API.

Essa cadeia de eventos, orquestrada de forma eficiente, transforma um atendimento reativo em proativo. O desafio aqui é garantir que o serviço que executa o LangChain (seu servidor/VPS) seja resiliente para lidar com os picos de requisições vindos do N8N ou do webhook da Evolution API.

8. O Papel dos Agentes LangChain

Os Agentes LangChain são mais avançados que as cadeias simples, pois permitem que o LLM decida qual Tool (Ferramenta) usar para atingir um objetivo. Por exemplo, você pode dar ao agente acesso a uma ferramenta de busca na web e outra para executar código Python.

Estatística Relevante: Pesquisas indicam que a adoção de agentes autônomos em ambientes empresariais deve crescer exponencialmente nos próximos três anos, movidos pela capacidade de usar múltiplas ferramentas (APIs, bancos de dados) de forma coerente.

Conclusão

Implementar soluções baseadas em LLMs transcende o mero uso da ChatGPT API. Requer uma compreensão profunda de orquestração (LangChain), uma infraestrutura confiável (sua VPS ou ambiente cloud) e a capacidade de conectar a inteligência artificial a sistemas de negócio reais via ferramentas como N8N ou Evolution API. Ao focar em RAG para contextualização e construir agentes inteligentes, você estará na vanguarda da automação.

Pronto para tirar seus projetos de IA do papel com uma base sólida? Se você precisa de um ambiente VPS otimizado, com segurança de ponta e performance garantida para rodar seus serviços de automação e modelos de IA, confira nossas ofertas de VPS no Brasil. Conte com a Host You Secure para ser o alicerce da sua inovação.

Leia também: Veja mais tutoriais de N8N

Comentários (0)

Ainda não há comentários. Seja o primeiro!