Vector Databases: O Guia Definitivo para Busca Semântica e Arquiteturas RAG

Vector Databases se tornaram a espinha dorsal da IA moderna, permitindo buscas rápidas e precisas baseadas em significado, e não apenas em correspondência exata de palavras-chave. Se você está construindo uma aplicação de IA que precisa de conhecimento contextualizado — como chatbots avançados, sistemas de recomendação ou ferramentas de busca empresarial — você inevitavelmente precisará de um Vector Database. A necessidade explodiu com a popularização das arquiteturas RAG (Retrieval-Augmented Generation), que combinam a capacidade de modelos LLMs com dados externos específicos.

Para quem trabalha com infraestrutura cloud e automação, como eu na Host You Secure, a otimização da camada de dados vetoriais é um ponto crítico de performance. Abaixo, detalhamos o que são, por que são necessários e como implementar as principais soluções do mercado.

O Papel Crítico dos Embeddings na Busca Moderna

Para que um computador entenda a similaridade entre 'gato persa' e 'felino de raça', ele precisa de uma representação numérica. É aí que entram os embeddings. Um embedding é um vetor de alta dimensão (geralmente centenas ou milhares de números flutuantes) gerado por modelos de linguagem (como BERT, OpenAI Ada) que captura o contexto semântico de um trecho de texto, imagem ou áudio.

Como os Vetores Transformam Dados em Informação

O processo é simples em teoria, mas intensivo em computação na prática:

- Geração do Embedding: O texto original (documento, pergunta do usuário) é passado por um modelo de embedding, que retorna o vetor correspondente.

- Armazenamento: Este vetor (junto com metadados e o texto original) é armazenado no Vector Database.

- Busca por Similaridade: Quando uma nova consulta chega, ela é convertida em um vetor de consulta. O banco de dados então calcula a distância vetorial (usando métricas como a similaridade de cosseno) entre o vetor da consulta e todos os vetores armazenados.

A Insuficiência das Bases de Dados Tradicionais

Bancos de dados relacionais (SQL) ou mesmo NoSQL tradicionais (como MongoDB para chaves simples) não são otimizados para essa tarefa. Eles utilizam índices baseados em chaves ou texto exato. Procurar por similaridade em milhões de vetores usando um índice B-tree tradicional resultaria em uma latência inaceitável. Precisamos de algoritmos de Approximate Nearest Neighbor (ANN), que são a especialidade dos Vector Databases.

Na minha experiência, já migrei clientes que tentavam simular busca vetorial com extensões PostgreSQL (como pgvector) para soluções nativas em vetores. Embora pgvector seja ótimo para começar, para cargas de produção com dezenas de milhões de vetores e latência abaixo de 100ms, uma solução dedicada oferece ganhos de escala substanciais. Estudos recentes indicam que a precisão na busca vetorial pode elevar a taxa de relevância de respostas de IA em até 40% em comparação com métodos baseados apenas em palavras-chave.

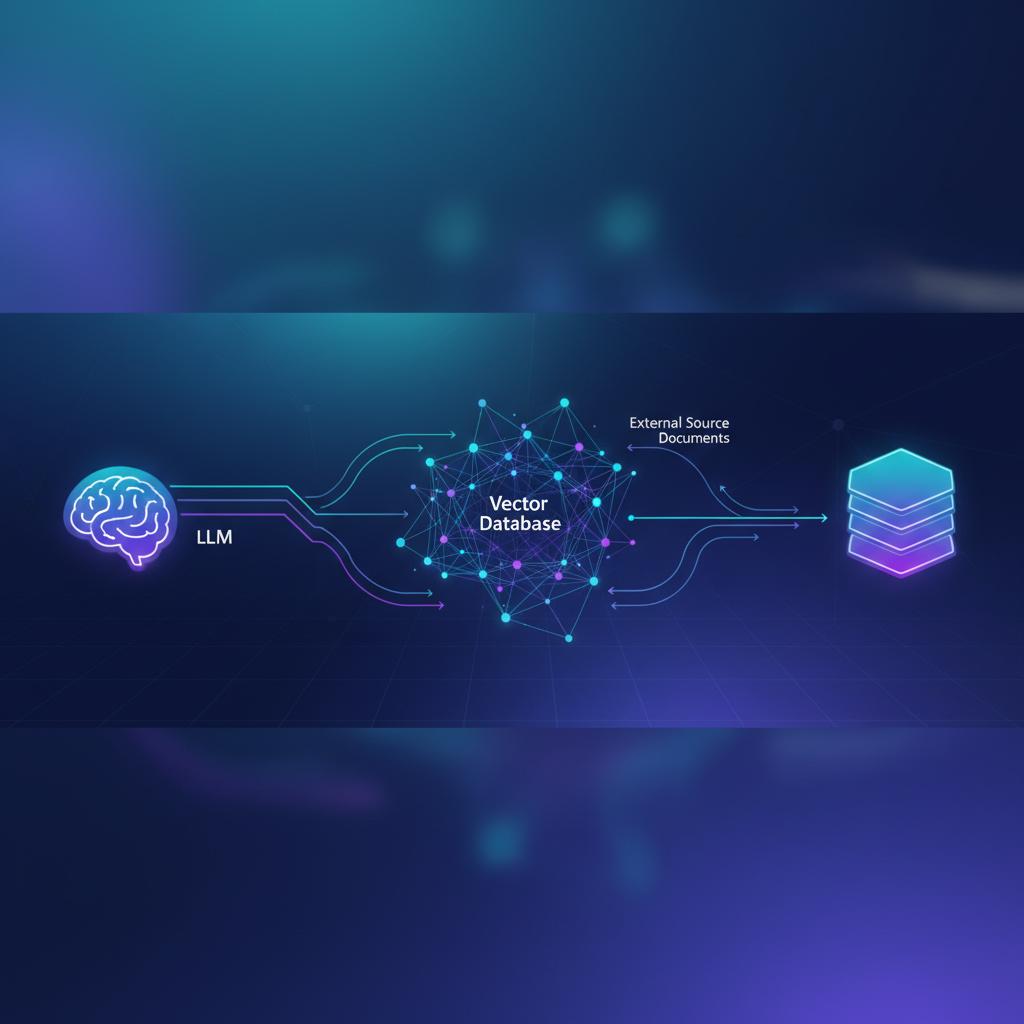

Arquitetura RAG: O Casamento de LLMs e Vetores

A arquitetura RAG resolve o problema fundamental dos LLMs: alucinação e falta de conhecimento específico e atualizado. O RAG insere um passo intermediário entre o usuário e o modelo generativo.

O Fluxo Detalhado do RAG

Um fluxo RAG bem-sucedido depende criticamente da velocidade e precisão do Vector Database:

- Passo 1 (Indexação): Documentos corporativos (manuais, PDFs, logs) são fragmentados (chunking) e transformados em embeddings, sendo persistidos no Vector DB.

- Passo 2 (Consulta): O usuário pergunta: "Qual é a política de férias para novos contratados?".

- Passo 3 (Recuperação): O Vector DB busca os 5 trechos de documentos mais semanticamente próximos à pergunta (usando Pinecone ou Weaviate).

- Passo 4 (Aumento - Augmentation): Os trechos recuperados são injetados no prompt do LLM (ex: GPT-4) como contexto.

- Passo 5 (Geração): O LLM gera a resposta baseada apenas no contexto fornecido, garantindo precisão e rastreabilidade.

Otimização do Chunking e Metadados

Um erro comum que vejo é o chunking mal dimensionado. Se os pedaços de texto (chunks) forem muito pequenos, perde-se o contexto; se forem muito grandes, o embedding fica diluído e a recuperação é imprecisa. A regra de ouro, que aprendi com anos de otimização, é:

Dica de Insider: Utilize um tamanho de chunk que corresponda a uma unidade lógica de informação (ex: um parágrafo ou seção completa), e não apenas um número fixo de tokens. Use metadados para filtrar antes da busca vetorial (ex: buscar apenas documentos do ano fiscal 2024, ou de um departamento específico). Isso reduz drasticamente o espaço de busca do ANN.

Principais Vector Databases: Pinecone, Weaviate e ChromaDB

A escolha da plataforma define a escalabilidade e a complexidade operacional do seu projeto. Cada uma tem seus pontos fortes. Para quem busca soluções escaláveis em nuvem, a infraestrutura que suporta esses bancos é vital; recomendamos sempre instanciar em VPS robustos ou ambientes gerenciados. Para quem está começando ou rodando localmente, veja a Host You Secure para VPS otimizados para IA.

Pinecone: A Solução Gerenciada de Alta Performance

Pinecone é frequentemente a escolha para aplicações de nível empresarial devido à sua natureza totalmente gerenciada (SaaS). Ele foca em latência extremamente baixa e escalabilidade massiva, gerenciando a complexidade da infraestrutura de índices ANN internamente.

- Vantagens: Facilidade de uso, escalabilidade elástica, alta disponibilidade nativa.

- Desvantagens: Custo pode ser mais elevado, menor controle sobre a infraestrutura subjacente.

Weaviate: Código Aberto e Híbrido Poderoso

Weaviate é uma excelente alternativa de código aberto que pode ser auto-hospedada ou usada como serviço gerenciado. Ele se destaca por suas capacidades de busca híbrida (vetorial + textual) e suporte nativo a módulos de geração e classificação.

# Exemplo de instalação básica via Docker para Weaviate

docker run -p 8080:8080 semitechnologies/weaviate:latestChromaDB: Leve e Integrado ao Ecossistema Python

ChromaDB ganhou popularidade por ser incrivelmente fácil de começar, especialmente para prototipagem e projetos menores. Ele pode rodar em modo 'in-memory' ou persistente, integrando-se perfeitamente com bibliotecas Python como LangChain.

Já ajudei clientes a migrarem protótipos baseados em ChromaDB para produção, e o ponto de atenção principal é a necessidade de reavaliar a infraestrutura de rede e persistência quando o volume de dados cresce exponencialmente. Para milhões de vetores, a arquitetura de Weaviate ou Pinecone tende a ser mais resiliente.

Desafios de Implementação e Escalabilidade em Infraestrutura

Apesar da promessa da busca semântica, implementar um sistema de vetores robusto requer atenção à infraestrutura. Um erro comum é subestimar a pegada de memória e CPU dos índices vetoriais.

Custo de Indexação e Latência de Inserção

A construção dos índices ANN (como HNSW, usado por muitos destes bancos) é um processo custoso. A inserção contínua de novos vetores pode impactar a latência de leitura, pois o banco precisa rebalancear ou reconstruir partes do índice.

A tabela abaixo resume a diferença de abordagem em termos de infraestrutura:

| Banco de Dados | Modelo de Implantação Principal | Foco em Escalabilidade | Complexidade Operacional |

|---|---|---|---|

| Pinecone | SaaS Gerenciado | Massiva (Elástica) | Baixa |

| Weaviate | Self-Hosted (Docker/K8s) ou Gerenciado | Alta (Configurável) | Média/Alta |

| ChromaDB | Local (In-memory/Persistente) | Baixa a Média | Baixa |

Monitoramento e Manutenção de Embeddings

A qualidade do seu sistema RAG depende da qualidade contínua dos seus embeddings. Um modelo de embedding que performa bem hoje pode não ser o ideal daqui a seis meses, devido à evolução do vocabulário. Monitore a performance da recuperação (recall@k) regularmente.

Para evitar o problema de vetores obsoletos, implemente um pipeline de reindexação automatizado usando ferramentas de automação como o N8N. Se você precisa de um ambiente VPS estável e otimizado para rodar esses bancos em sua infraestrutura, confira nossas opções em Comprar VPS no Brasil.

O Futuro: Vetores Multimodais e Busca Vetorial Híbrida

O futuro dos Vector Databases não se limita apenas ao texto. Estamos vendo uma convergência para a busca multimodal, onde um único índice pode armazenar vetores para texto, imagem e áudio. Isso impulsiona sistemas de busca mais ricos, como encontrar um produto em uma loja online apenas descrevendo-o em palavras e mostrando uma foto de referência.

A Importância da Busca Híbrida (Recuperação Híbrida)

Ainda que a busca semântica seja poderosa, ela falha em termos exatos. Se um usuário buscar "SKU-45B-AZ", a busca puramente vetorial pode retornar itens contextualmente similares, mas o SKU exato. A solução é a busca híbrida, que combina os resultados de uma busca por termo exato (usando BM25 ou índices tradicionais) com a busca vetorial. Bases como Weaviate têm implementado isso nativamente, resultando em um aumento notável na relevância final para consultas técnicas. Este é um ponto que sempre reforço com meus clientes: não abandone a busca por palavra-chave; integre-a.

Implementar essas tecnologias exige mais do que apenas código; exige uma infraestrutura sólida e escalável. A Host You Secure é especialista em prover ambientes que garantem a baixa latência necessária para que suas interações RAG sejam instantâneas. Se você deseja se aprofundar em automação de infraestrutura para IA, explore mais em nosso blog.

Conclusão

Vector Databases como Pinecone, Weaviate e ChromaDB são componentes indispensáveis na pilha tecnológica da Inteligência Artificial moderna, servindo como o cérebro de recuperação para sistemas RAG. Eles traduzem a linguagem humana em um formato matemático que permite buscas rápidas por significado. Dominar o ciclo de vida dos embeddings, o chunking correto e a escolha da infraestrutura certa é o que separa um protótipo de um produto de IA escalável e confiável. Comece pequeno com ChromaDB se for prototipar, mas planeje a migração para soluções mais robustas como Weaviate ou Pinecone para produção.

Leia também: Veja mais tutoriais de N8N

Comentários (0)

Ainda não há comentários. Seja o primeiro!