Docker: A Plataforma que Revolucionou o Deploy e o DevOps

O Docker se tornou uma pedra angular da infraestrutura moderna, mudando fundamentalmente a forma como construímos, enviamos e executamos software. Se você está migrando do ambiente tradicional de máquinas virtuais ou buscando otimizar pipelines de CI/CD, entender o Docker não é mais opcional; é essencial. Para quem trabalha com infraestrutura em Hospedagem VPS, como na Host You Secure, a capacidade de isolar e replicar ambientes rapidamente via containers é um divisor de águas.

Este guia prático, baseado em mais de cinco anos de experiência lidando com implantações complexas, detalhará o que é Docker, como ele se encaixa no fluxo de DevOps e as melhores práticas para usá-lo em seus projetos.

O que é Docker e Como Ele Difere das Máquinas Virtuais?

Em sua essência, Docker é uma ferramenta que facilita a criação, o deploy e a execução de aplicações usando containers. Um container é um pacote de software leve, autônomo e executável que inclui tudo o que é necessário para rodar: código, runtime, ferramentas do sistema, bibliotecas e configurações. A mágica reside no isolamento:

1. A Arquitetura de Containers: Isolamento Leve

Ao contrário das Máquinas Virtuais (VMs), que precisam de um sistema operacional completo (Guest OS) e um Hypervisor para virtualizar hardware, os containers compartilham o kernel do sistema operacional hospedeiro. Isso os torna drasticamente menores e mais rápidos para iniciar.

- VMs: Mais pesadas, inicialização em minutos, isolamento de hardware.

- Containers: Leves, inicialização em segundos (às vezes milissegundos), isolamento de processo.

Dado de Mercado: Pesquisas recentes indicam que containers iniciam até 10 vezes mais rápido que VMs. Essa velocidade é crítica para o escalonamento rápido em arquiteturas de microsserviços.

2. Imagens e Containers: Os Blocos de Construção

É crucial entender a distinção entre a Imagem e o Container:

- Imagem Docker: Um modelo imutável, somente leitura, criado a partir de um Dockerfile. Pense nele como a classe em programação orientada a objetos.

- Container Docker: Uma instância em execução da Imagem. Você pode ter múltiplas instâncias (containers) rodando a partir de uma única Imagem.

Dica de Insider: Sempre que possível, construa suas imagens com a menor base possível (ex: usar alpine em vez de distribuições completas) para reduzir a superfície de ataque e acelerar o tempo de pull/push do registro.

Dockerfile: A Receita para a Reprodutibilidade

O coração de qualquer aplicação Dockerizada é o Dockerfile. Este é um arquivo de texto simples que contém uma série de instruções que o Docker Engine executa para construir sua imagem. É a definição formal do seu ambiente.

A Estrutura Fundamental do Dockerfile

Um Dockerfile bem escrito segue uma ordem lógica. A seguir, um exemplo básico para uma aplicação Node.js:

# 1. IMAGEM BASE

FROM node:18-alpine

# 2. DIRETÓRIO DE TRABALHO

WORKDIR /usr/src/app

# 3. CÓPIAS DE DEPENDÊNCIAS (Cache Layer Optimization)

COPY package*.json .

RUN npm install

# 4. CÓPIA DO CÓDIGO FONTE

COPY . .

# 5. EXPOSIÇÃO DE PORTA

EXPOSE 3000

# 6. COMANDO DE EXECUÇÃO

CMD [ "npm", "start" ]

Otimizando a Camada de Cache (Layer Caching)

Na minha experiência, o erro mais comum que atrasa builds é não otimizar o cache. O Docker executa as instruções do Dockerfile em camadas sequenciais. Se uma instrução mudar, todas as camadas subsequentes precisam ser reconstruídas. Por isso, você deve copiar e instalar dependências (que mudam com menos frequência) antes de copiar o código-fonte (que muda constantemente).

Exemplo Prático: Já ajudei clientes que demoravam 5 minutos para construir suas imagens porque copiavam todo o repositório primeiro. Ao reordenar para copiar apenas package.json, instalar dependências e, só então, copiar o resto do código, reduzimos o tempo de build para menos de 45 segundos na maioria das vezes, graças ao cache de camadas.

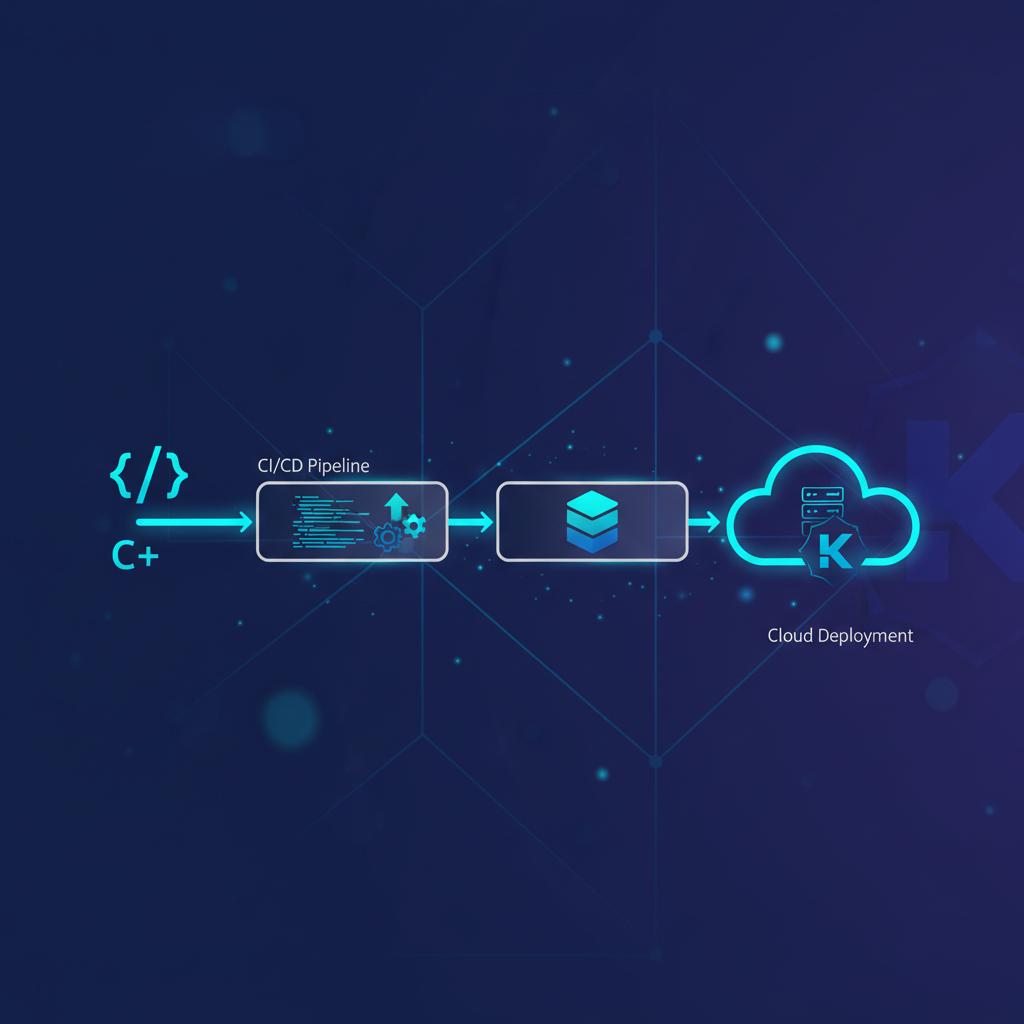

Docker e DevOps: A Sinergia Perfeita

O Docker é um facilitador chave para a filosofia DevOps, promovendo a cultura de automação, colaboração e entrega contínua (CI/CD). O objetivo é reduzir o atrito entre desenvolvimento e operação.

1. Padronização do Ambiente (The Environment Parity)

A maior dor que o Docker resolve é a inconsistência de ambiente. Com containers, o ambiente de desenvolvimento é idêntico ao de homologação e produção. Isso reduz drasticamente os bugs de integração.

Estatística Relevante: Um estudo da Puppet revelou que equipes de alta performance (que adotam práticas DevOps maduras) implementam mudanças 200 vezes mais frequentemente do que equipes de baixa performance, e o Docker é fundamental para essa agilidade.

2. Simplificando o Deploy com Imagens

O processo de deploy se resume a apenas mover e executar uma imagem. Se você usa um provedor de VPS, como os que oferecemos na Host You Secure, você pode simplesmente executar docker pull nome-da-imagem seguido de docker run, e sua aplicação estará no ar em minutos, sem a necessidade de instalar runtimes, bibliotecas ou configurar variáveis de ambiente manualmente no servidor hospedeiro.

Para automatizar isso, usamos ferramentas de CI/CD (como GitLab CI ou GitHub Actions) que, após o teste bem-sucedido, fazem o push da imagem para um registro (Docker Hub, ECR, etc.) e, em seguida, executam um script de deploy no servidor alvo.

3. A Necessidade da Orquestração

Embora o Docker seja excelente para rodar um ou poucos containers em uma única máquina, em ambientes de produção complexos com dezenas de microsserviços, você precisa de orquestração. É aí que ferramentas como Kubernetes (K8s) ou Docker Swarm entram em cena.

A orquestração gerencia:

- Escalonamento automático (Horizontal Pod Autoscaling).

- Auto-recuperação (restart de containers falhos).

- Balanceamento de carga entre instâncias.

- Gerenciamento de rede e descoberta de serviços.

Tópicos Avançados: Docker Compose e Networking

Para aplicações que dependem de múltiplos serviços (ex: um backend, um banco de dados e um cache Redis), gerenciar cada container individualmente com docker run se torna impraticável. O Docker Compose resolve isso.

Docker Compose: Definindo Multi-Container

O Compose usa um arquivo YAML (docker-compose.yml) para definir e rodar aplicações multi-container. Ele permite que você defina serviços, redes e volumes de forma declarativa, facilitando o desenvolvimento local.

version: '3.8'

services:

web:

build: .

ports:

- "8080:8080"

depends_on:

- db

db:

image: postgres:14

environment:

POSTGRES_PASSWORD: securepassword

Networking em Containers: O Isolamento da Rede

Por padrão, containers criados pelo Compose ou pelo Docker Engine em uma mesma rede bridge podem se comunicar usando o nome do serviço como hostname. Este é um ponto fundamental para a segurança e a comunicação interna. Lembre-se: containers não devem expor portas desnecessariamente para a rede externa.

Erro Comum a Evitar: Muitos iniciantes mapeiam a porta do banco de dados diretamente para a máquina hospedeira (host). Isso expõe o banco de dados à internet. O correto é que apenas o serviço web principal exponha a porta, e a comunicação com o banco ocorra internamente pela rede Docker.

Segurança e Boas Práticas na Produção

Adotar Docker sem pensar em segurança é convidar problemas. Embora containers sejam isolados, eles não são intrinsecamente 100% seguros se mal configurados. Para um deploy robusto, siga estas práticas:

- Não Rode como Root: Configure seu container para rodar como um usuário não-root. Isso limita o dano se um invasor conseguir escapar do container.

- Use Imagens Oficiais e Mínimas: Prefira imagens baseadas em Alpine ou distros mínimas, pois elas contêm menos pacotes e, consequentemente, menos vulnerabilidades conhecidas.

- Gerenciamento de Segredos: Nunca coloque senhas ou chaves de API diretamente no

Dockerfileou nos arquivos de configuração versionados. Use variáveis de ambiente passadas no momento dodocker runou, idealmente, utilize um gerenciador de segredos como Kubernetes Secrets ou HashiCorp Vault, especialmente em ambientes de orquestração. - Scanning de Imagens: Utilize ferramentas de scanner (como Trivy ou Snyk) em seu pipeline CI/CD para verificar vulnerabilidades nas camadas da imagem antes do deploy em produção.

Para quem gerencia infraestrutura, garantir que seus servidores VPS estejam configurados corretamente para rodar o Docker de forma segura, com isolamento de recursos e kernel atualizado, é responsabilidade do provedor de hospedagem, mas a configuração do container é sua. Se precisar de ajuda para configurar seu ambiente VPS otimizado para containers, consulte nossas soluções na Host You Secure.

Conclusão: O Futuro é Containerizado

O Docker simplificou a complexidade da infraestrutura, trazendo a portabilidade e a reprodutibilidade para o centro do desenvolvimento de software. Ao dominar containers, Dockerfiles e entender o papel da orquestração, você está pronto para acelerar seus ciclos de deploy e alinhar-se perfeitamente com as metas de DevOps.

Comece pequeno: containerize seu próximo serviço simples com um Dockerfile bem otimizado e veja a diferença na velocidade do seu desenvolvimento. Explore mais sobre automação de infraestrutura e como podemos otimizar seu ambiente em nosso blog. Se precisar de uma infraestrutura escalável e pronta para containers, confira nossas opções de VPS otimizadas.

Leia também: Veja mais tutoriais de N8N

Comentários (0)

Ainda não há comentários. Seja o primeiro!