Docker: O Guia Essencial para Containers, DevOps e Deploy de Aplicações

Docker revolucionou o ecossistema de desenvolvimento e infraestrutura, tornando-se um pilar central na arquitetura de software moderna. Se você já enfrentou problemas de inconsistência entre ambientes de desenvolvimento, teste e produção, o Docker é a solução que você precisa conhecer. Como especialista em infraestrutura cloud e automação na Host You Secure, vejo diariamente o impacto positivo que a adoção de containers tem na agilidade e confiabilidade dos projetos dos meus clientes.

Este artigo abordará o que é Docker, como ele se encaixa no paradigma DevOps, os componentes chave e as melhores práticas para começar a utilizá-lo de forma eficiente em seus projetos. A resposta direta é: Docker permite que você empacote uma aplicação e todas as suas dependências em um pacote leve, padronizado e isolado, chamado container, eliminando surpresas durante o deploy.

O Que São Containers e Por Que Eles São Diferentes de Máquinas Virtuais?

Para entender o valor do Docker, primeiro precisamos diferenciar containers de Máquinas Virtuais (VMs). As VMs virtualizam o hardware, exigindo um sistema operacional completo (Guest OS) rodando em cima de um Hypervisor.

Virtualização Leve vs. Pesada

O Container, por outro lado, virtualiza o sistema operacional (OS) no nível do kernel. Em vez de carregar um SO inteiro para cada aplicação, todos os containers em um host compartilham o kernel do sistema operacional hospedeiro. Isso resulta em:

- Inicialização Rápida: Containers iniciam em milissegundos, enquanto VMs demoram minutos.

- Menor Consumo de Recursos: São significativamente mais leves, exigindo menos CPU e RAM.

- Portabilidade Inigualável: Um container empacota tudo: código, runtime, bibliotecas e configurações, garantindo que ele rode identicamente em qualquer lugar que o Docker esteja instalado.

Dados de mercado indicam que a adoção de containers cresceu exponencialmente. Segundo a CNCF (Cloud Native Computing Foundation), mais de 80% das organizações já utilizam ou planejam adotar containers em seus ambientes de produção até 2025, solidificando a importância de dominar esta tecnologia.

Componentes Fundamentais do Docker

O ecossistema Docker é composto por três pilares principais:

- Docker Engine: O daemon que roda no sistema operacional hospedeiro e gerencia a criação, execução e distribuição dos containers.

- Docker Images: São os modelos estáticos e imutáveis que contêm as instruções para criar um container. Elas são construídas a partir de um

Dockerfile. - Docker Registries (Ex: Docker Hub): Repositórios para armazenar e compartilhar imagens Docker publicamente ou privadamente.

Docker e DevOps: A Sinergia da Automação

A adoção do Docker é quase sinônimo de adotar uma cultura DevOps moderna. A capacidade de criar um ambiente isolado e reprodutível elimina barreiras entre desenvolvimento e operações.

Padronização e Imutabilidade

Na minha experiência ajudando clientes a migrarem para arquiteturas modernas, o maior ganho inicial é a Imutabilidade. Um container, uma vez construído, não deve ser alterado em tempo de execução. Se um bug é encontrado, você não corrige o container rodando; você modifica o Dockerfile, reconstrói a imagem e faz um novo deploy.

Este conceito é vital para a qualidade do software. Um erro comum que vejo em clientes iniciantes é tentar fazer atualizações manuais dentro de um container em produção. Isso quebra a idempotência e a rastreabilidade. A dica de insider aqui é: sempre trate seus containers como descartáveis.

# Exemplo de falha comum: Modificar em tempo de execução

docker exec -it meu_app_prod bash

apt-get update && apt-get upgrade # NÃO FAÇA ISSO!

Integração Contínua e Deploy Contínuo (CI/CD)

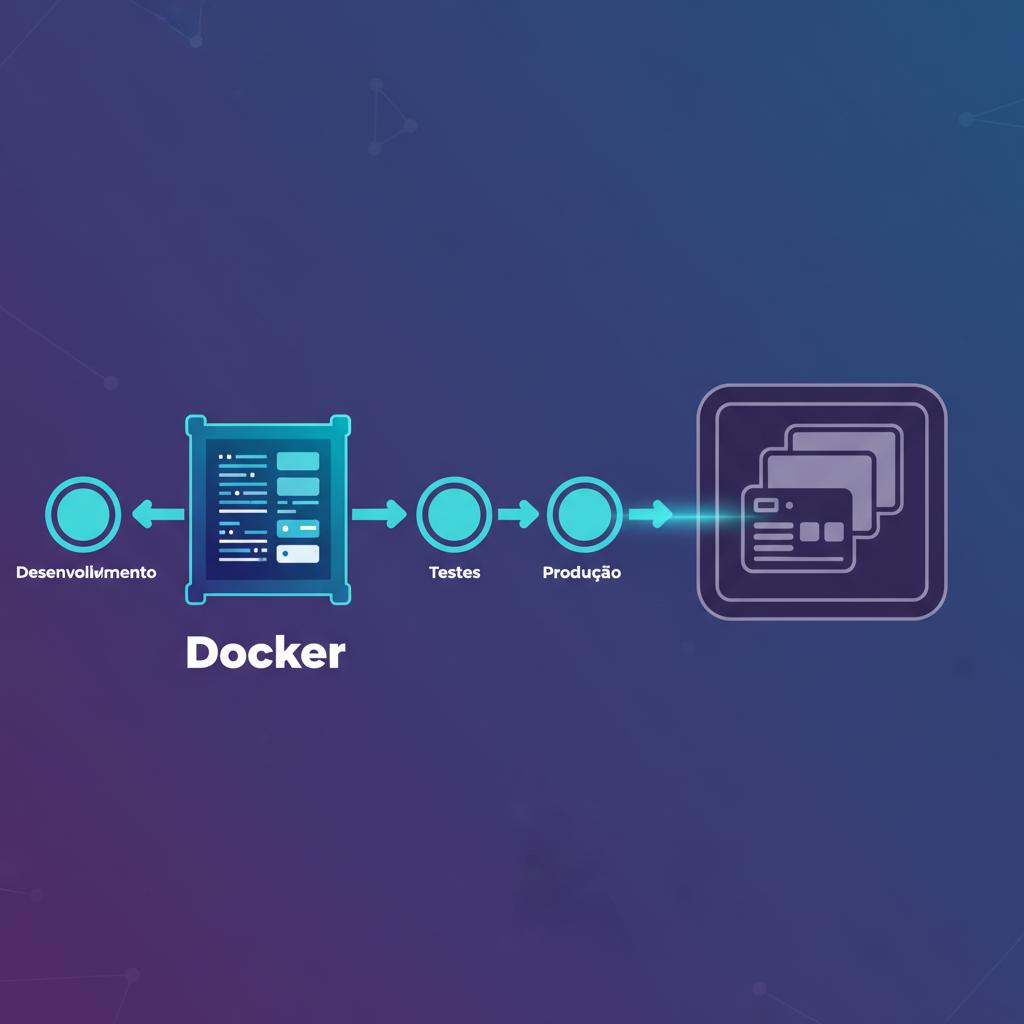

O Docker simplifica drasticamente os pipelines de CI/CD. O fluxo se torna:

- Desenvolvedor commita código.

- Serviço de CI (Jenkins, GitLab CI, GitHub Actions) executa testes.

- Se os testes passarem, o pipeline constrói a Docker Image usando o

Dockerfile. - A imagem é enviada para o Registry.

- O orquestrador (Kubernetes ou Docker Swarm) faz o deploy da nova imagem para os servidores de produção.

Essa fluidez é crucial. Já ajudei clientes que levavam horas para configurar um ambiente de homologação; com Docker, o ambiente se torna um artefato pronto para uso, rodando em segundos.

Construindo Imagens Eficientes com Dockerfile

O Dockerfile é o coração da criação de sua aplicação empacotada. Ele é uma lista de instruções textuais que o Docker Engine segue para construir a imagem final.

Otimizando a Construção da Imagem

Imagens grandes são lentas para baixar e consomem mais espaço em disco, impactando o tempo de recuperação de desastres e o custo de hospedagem. A otimização começa com a escolha da imagem base:

- Use Imagens Oficiais e Mínimas: Prefira bases como

alpineou as variaçõesslimdas imagens oficiais (ex:node:18-alpine). - Aproveite o Cache: Reordene as instruções no Dockerfile para que as camadas que mudam com menos frequência (como a instalação de dependências) venham primeiro.

- Use Multi-Stage Builds: Esta técnica permite usar uma imagem grande (com compiladores e ferramentas de desenvolvimento) para construir o artefato, e então copiar apenas o artefato final (muitas vezes um binário simples) para uma imagem base leve de runtime. Isso reduz drasticamente o tamanho final.

# Exemplo de Dockerfile com Multi-Stage Build para Go

# Stage 1: Builder

FROM golang:1.21 AS builder

WORKDIR /app

COPY . .

RUN CGO_ENABLED=0 GOOS=linux go build -o meu_servico .

# Stage 2: Final Image (Leve)

FROM alpine:latest

WORKDIR /app

COPY --from=builder /app/meu_servico .

CMD ["./meu_servico"]

Gerenciando Dependências Externas (Volumes e Redes)

Containers são, por natureza, efêmeros. Seus dados não devem ser armazenados dentro do container. Para dados persistentes (bancos de dados, uploads), você deve utilizar Volumes. Se você estiver rodando um banco de dados em um container, por exemplo, o volume garante que os dados sobrevivam à destruição do container.

Para comunicação entre serviços, Docker cria redes virtuais. Ao rodar múltiplos containers, utilize o docker-compose para definí-los em uma rede comum, permitindo que se comuniquem por nome de serviço, e não por IP dinâmico.

Orquestração: Gerenciando Containers em Escala

Enquanto o Docker CLI gerencia containers em uma única máquina, ambientes de produção exigem a gestão de dezenas ou centenas de containers espalhados por vários servidores. É aí que entra a orquestração.

Kubernetes vs. Docker Swarm

O desafio da orquestração é automatizar tarefas como:

- Escalonamento automático (auto-scaling).

- Balanceamento de carga entre réplicas.

- Auto-recuperação (restarting containers falhos).

- Gerenciamento de segredos e configurações.

Embora o Kubernetes (K8s) seja o padrão de mercado atual, Docker Swarm ainda é uma excelente porta de entrada por ser nativo e muito mais simples de configurar. No entanto, para infraestruturas robustas e que buscam interoperabilidade com a maioria dos provedores de cloud, K8s é a escolha dominante. Uma estatística relevante é que mais de 75% das empresas que utilizam orquestradores optam pelo Kubernetes.

A Importância da Host You Secure na Camada VPS

A base para rodar seus containers de forma eficiente e segura é a sua infraestrutura de hospedagem. Utilizar um VPS adequado é crucial. Muitos clientes que migram para Docker percebem que precisam de um VPS com mais recursos de CPU e memória para suportar a densidade de containers, ou migrar para uma solução gerenciada. Oferecemos soluções de VPS otimizadas para conteinerização, garantindo que seu motor Docker tenha recursos garantidos para performar no pico. Confira nossos planos otimizados para Docker aqui.

Desafios Comuns e Como Superá-los com Docker

Apesar de sua simplicidade aparente, a transição para Docker apresenta armadilhas. A experiência real ensina a prever e mitigar esses problemas.

Problema 1: Gerenciamento de Logs

Containers geram logs no STDOUT/STDERR. Se você não configurar um sistema de coleta, esses logs se perdem quando o container é reiniciado. O erro comum é depender apenas do docker logs.

Solução: Configure um sistema centralizado de logs (ELK Stack, Loki) ou use um orquestrador para gerenciar o envio desses logs para um serviço externo. Isso é vital para auditoria e troubleshooting.

Problema 2: Falha na Persistência de Dados

Conforme mencionado, dados voláteis são perdidos. Isso acontece muito com bancos de dados (MySQL, PostgreSQL) rodando sem volumes mapeados.

Solução: Sempre utilize volumes nomeados ou bind mounts para qualquer dado que precise sobreviver ao ciclo de vida do container. Para desenvolvimento local, docker-compose facilita a definição desses volumes.

Problema 3: Segurança das Imagens

Usar imagens base antigas ou vulneráveis é um risco de segurança enorme. Uma aplicação que roda em um container desatualizado é um vetor de ataque aberto.

Solução: Implemente varreduras de vulnerabilidade (como Trivy ou Clair) no seu pipeline de CI/CD. Atualize regularmente as imagens base e use o princípio do menor privilégio (ex: não rodar processos como root dentro do container).

Conclusão e Próximos Passos

Docker é mais do que uma ferramenta; é uma filosofia que impulsiona a eficiência no desenvolvimento e no deploy de aplicações. Ao dominar os conceitos de imagens, volumes e integração com pipelines de DevOps, você ganha velocidade, previsibilidade e escalabilidade.

Se você está pronto para levar sua infraestrutura ao próximo nível, começando com a fundação correta, explore como a Host You Secure pode fornecer a infraestrutura VPS robusta que seus containers merecem. Para aprofundar seus conhecimentos em automação e orquestração, continue acompanhando nossos artigos técnicos aqui no nosso blog.

Leia também: Veja mais tutoriais de N8N

Comentários (0)

Ainda não há comentários. Seja o primeiro!