Docker: O Guia Essencial para Containers e DevOps

Se você trabalha com desenvolvimento de software ou infraestrutura hoje, inevitavelmente ouvirá a palavra Docker. O Docker não é apenas uma ferramenta; é um paradigma que transformou a entrega de software, tornando o processo mais rápido, confiável e repetível. Mas, afinal, o que torna o Docker tão poderoso e por que ele se tornou o padrão de fato na indústria de tecnologia? Este artigo, baseado em mais de cinco anos de experiência em infraestrutura cloud e automação, detalha os pilares do Docker e como você pode utilizá-lo para revolucionar seus projetos.

Para responder diretamente à sua dúvida: Docker é uma plataforma que permite empacotar aplicações e suas dependências em unidades isoladas chamadas containers, garantindo que o software funcione de maneira consistente em qualquer ambiente. Ele simplifica o processo de deploy, elimina o problema "funciona na minha máquina" e é a base para práticas modernas de DevOps e orquestração.

O que são Containers e a Revolução Docker

Antes de mergulharmos no Docker, precisamos entender o conceito central: os containers. Historicamente, tínhamos a virtualização tradicional (máquinas virtuais - VMs), onde cada aplicação rodava em seu próprio sistema operacional convidado, consumindo muitos recursos. O container mudou isso.

Containers vs. Máquinas Virtuais (VMs)

A principal diferença reside na camada de abstração. Enquanto as VMs virtualizam o hardware, os containers virtualizam o sistema operacional (SO). Eles compartilham o kernel do SO hospedeiro, mas cada container possui seu próprio espaço de usuário, processos, sistemas de arquivos e rede isolados.

- VMs: Mais pesadas, boot lento, cada uma tem seu SO completo. Ideal para rodar sistemas operacionais diferentes no mesmo hardware.

- Containers: Leves, boot quase instantâneo, compartilham o kernel. Ideais para isolar aplicações e suas dependências.

Segundo pesquisas recentes de mercado, a adoção de containers tem crescido exponencialmente. Estima-se que mais de 75% das empresas de grande porte já utilizam containers em produção, um testemunho do ganho de eficiência que eles proporcionam.

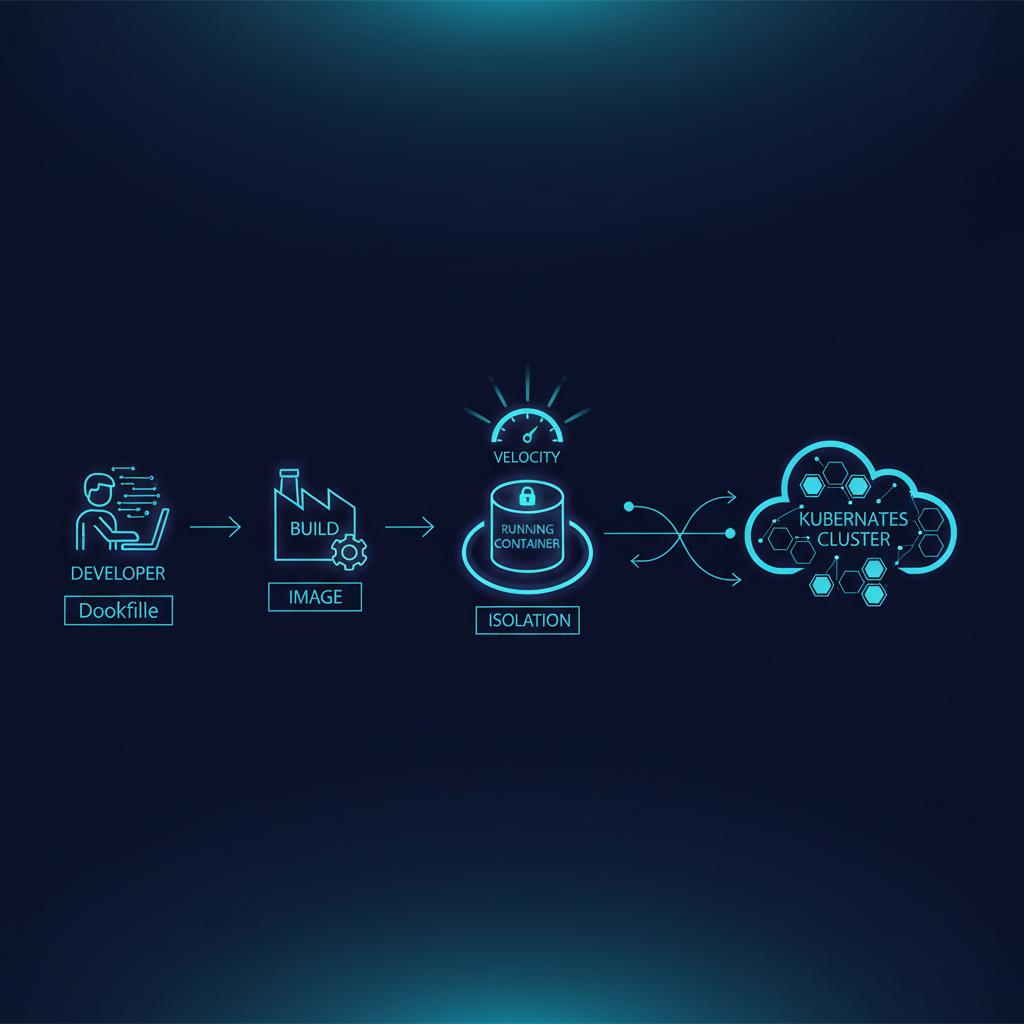

Os Componentes Fundamentais do Docker

O ecossistema Docker é composto por três elementos principais que você usará diariamente:

- Dockerfile: Um arquivo de texto simples que contém todas as instruções necessárias para construir uma imagem Docker. É essencialmente a "receita" da sua aplicação empacotada.

- Imagens (Images): O artefato de leitura imutável que contém o código da aplicação, bibliotecas, binários e configurações. Imagens são construídas a partir de um Dockerfile.

- Containers: Uma instância em execução de uma imagem. Você pode iniciar, parar, mover e deletar containers.

Na minha experiência, a padronização do Dockerfile é o ponto onde muitas equipes iniciantes erram. Um Dockerfile mal otimizado pode resultar em imagens enormes e lentas. Por exemplo, em projetos Node.js, utilize sempre o estágio FROM node:alpine em vez de apenas FROM node para reduzir drasticamente o tamanho final da imagem.

Construindo e Gerenciando Imagens com Dockerfiles

O poder do Docker reside na sua reprodutibilidade, e isso é orquestrado pelo Dockerfile. Ele transforma um processo manual e propenso a erros em uma sequência automatizada e auditável.

Otimizando Seu Dockerfile para Produção

Um bom Dockerfile segue o princípio de camadas (layers). O Docker armazena cada instrução como uma camada, e reutilizar camadas já existentes acelera builds futuros. Aqui está uma dica de insider:

Dica de Otimização: Coloque as instruções que mudam com menos frequência (como a instalação de dependências do sistema operacional) no topo, e as que mudam constantemente (como copiar o código fonte) no final. Isso maximiza o uso do cache do Docker.

# Exemplo de Dockerfile Otimizado

FROM ubuntu:22.04 AS builder

# Camadas que mudam pouco: Instalação de pacotes base

RUN apt-get update && apt-get install -y python3 python3-pip

# Copia dependências primeiro para aproveitar o cache

COPY requirements.txt .

RUN pip3 install -r requirements.txt

# Copia o código fonte (muda mais frequentemente)

COPY . .

CMD ["python3", "app.py"]Para quem está começando, o comando principal para iniciar o processo é docker build -t meu-app:v1 .. Este comando lê o Dockerfile no diretório atual e cria a imagem rotulada como meu-app:v1.

Gerenciamento de Imagens e Cleanup

Com o tempo, seu sistema acumula imagens antigas, volumes e containers parados, consumindo espaço valioso. A manutenção é crucial, especialmente em ambientes de desenvolvimento local.

Um comando que sempre uso para liberar espaço de forma segura é o docker system prune. Este comando remove:

- Containers parados

- Redes não utilizadas

- Imagens pendentes (sem tags)

- Cache de build

Erro Comum a Evitar: Não use docker system prune -a em produção ou em ambientes de CI/CD sem entender completamente o que está sendo removido, pois isso força o download de todas as imagens novamente, aumentando o tempo de inicialização.

Docker na Prática: Isolamento e Portabilidade

O principal benefício prático do Docker é a portabilidade inerente. Se funciona no seu laptop rodando no Windows com WSL2, funcionará no servidor Linux da produção. Já ajudei clientes que gastavam dias resolvendo problemas de dependência de bibliotecas entre ambientes de Staging e Produção; o Docker resolveu isso em horas, padronizando o ambiente de execução.

Isolamento de Serviços com Containers

Considere um cenário comum: sua aplicação web precisa de um banco de dados PostgreSQL e um cache Redis. Em uma VM tradicional, você precisaria instalar e configurar esses três softwares no mesmo servidor, lidando com versões e conflitos de portas.

Com Docker, você define três containers separados, cada um com sua versão exata de software, rodando em suas próprias redes internas. Isso é o isolamento.

Para orquestrar múltiplos containers juntos (como o app, DB e Redis), introduzimos o Docker Compose. O Docker Compose utiliza um arquivo YAML (geralmente chamado docker-compose.yml) para definir e rodar aplicações multi-container.

Exemplo de Docker Compose para um Serviço Web Básico

version: '3.8'

services:

web:

build: .

ports:

- "8080:80"

environment:

- DB_HOST=database

database:

image: postgres:14-alpine

environment:

- POSTGRES_PASSWORD=minhasenha

volumes:

- db_data:/var/lib/postgresql/data

volumes:

db_data:

Ao rodar docker compose up -d, o Compose cria a rede, inicia o PostgreSQL (com persistência de dados via volume) e inicia sua aplicação web, configurando-a para se comunicar com o banco de dados usando o nome do serviço (database) como host.

A Importância dos Volumes para Persistência de Dados

Um container é efêmero por natureza; se você deletar a instância, todos os dados gerados dentro dele somem. Para bancos de dados ou aplicações que geram logs importantes, precisamos de Volumes. Um volume é uma forma gerenciada pelo Docker de persistir dados fora do ciclo de vida do container.

Lembre-se: Em ambientes de produção, você não deve rodar bancos de dados críticos diretamente no Docker Desktop sem volumes persistentes mapeados para armazenamento externo ou gerenciado pelo orquestrador. Essa é uma falha clássica que leva à perda de dados!

Docker e a Cultura DevOps: Automação e CI/CD

Onde o Docker brilha de verdade é no casamento com as práticas de DevOps. A automação da infraestrutura e do deploy é facilitada drasticamente quando o artefato de entrega é um container imutável.

Integrando Docker em Pipelines de CI/CD

Em um pipeline de Integração Contínua (CI), o fluxo ideal com Docker se parece com isto:

- O desenvolvedor envia o código para o repositório (Git).

- O servidor de CI (Jenkins, GitLab CI, GitHub Actions) detecta a mudança.

- O servidor executa os testes unitários e de integração dentro de containers efêmeros.

- Se os testes passarem, o servidor executa

docker build, criando a imagem final. - A imagem é enviada (push) para um Registry (ex: Docker Hub, ECR, GCR).

- O servidor de CD (Entrega Contínua) atualiza o ambiente de Staging ou Produção, instruindo o orquestrador a rodar a nova versão da imagem.

Esta abordagem garante que o ambiente que foi testado (a imagem) é exatamente o mesmo que será executado em produção. Dados mostram que organizações que utilizam amplamente containers e CI/CD conseguem realizar deployments 200 vezes mais frequentemente e com taxas de falha 7 vezes menores.

Containers e a Escolha de Hospedagem

A adoção do Docker exige uma mudança na sua estratégia de hospedagem. Servidores dedicados ou VPS tradicionais podem ser usados, mas o verdadeiro potencial dos containers é desbloqueado com ferramentas de orquestração como Kubernetes ou Docker Swarm.

Na Host You Secure, auxiliamos clientes na migração de arquiteturas monolíticas para ambientes containerizados em nossos VPS otimizados. Se você busca a flexibilidade dos containers sem a dor de cabeça da infraestrutura complexa inicial, oferecemos soluções de VPS robustas. Confira nossos planos de VPS otimizados para containerização aqui.

Desafios e o Futuro: Orquestração

Embora o Docker seja fantástico para desenvolver e rodar aplicações localmente ou em um único servidor, ele não é projetado para gerenciar centenas de containers espalhados por diversos hosts com alta disponibilidade. É aí que entra a orquestração.

Quando o Docker Sozinho Não Basta

Para ambientes de produção escaláveis, você enfrentará desafios que o Docker CLI puro não resolve:

- Escalabilidade: Como iniciar mais 5 réplicas da minha aplicação rapidamente?

- Auto-healing: O que acontece se um nó do cluster cair? Quem realoca os containers?

- Balanceamento de Carga: Como distribuir o tráfego uniformemente entre as instâncias?

A resposta para esses desafios é Kubernetes (K8s). Kubernetes utiliza os containers Docker como sua unidade básica de trabalho, mas adiciona toda a camada de gerenciamento de infraestrutura, rede e escalabilidade. Docker e Kubernetes são, portanto, complementares.

Dica Avançada: Segurança em Imagens

Um erro comum que vejo é negligenciar a segurança das imagens. Sempre utilize imagens base mínimas (como Alpine) e evite rodar processos como root dentro do container. No seu Dockerfile, inclua o comando USER non_root_user. Isso segue o princípio do menor privilégio e mitiga riscos significativos caso um atacante consiga explorar uma vulnerabilidade no seu container. Você pode analisar a composição da sua imagem com ferramentas como Trivy ou Clair antes do deploy.

Conclusão: O Docker como Alavanca de Produtividade

O Docker transcendeu a fase de "moda" e se estabeleceu como uma tecnologia essencial para a engenharia de software moderna. Ele garante que seu ambiente de desenvolvimento espelhe a produção, acelera ciclos de feedback através do CI/CD e serve como a fundação para arquiteturas baseadas em microsserviços e orquestração avançada.

Dominar o Dockerfile, entender os princípios de camadas e saber quando utilizar o Docker Compose são passos cruciais para qualquer profissional de infraestrutura ou desenvolvedor que busca eficiência. Se você está pronto para levar sua infraestrutura para o próximo nível, seja padronizando seu deploy localmente ou preparando seus artefatos para Kubernetes, comece investindo tempo no domínio desses conceitos básicos.

Gostou deste aprofundamento técnico? Continue explorando como integrar estas ferramentas em sua rotina. Para mais artigos sobre automação e infraestrutura, visite nosso blog da Host You Secure.

Leia também: Veja mais tutoriais de N8N

Comentários (0)

Ainda não há comentários. Seja o primeiro!